“AI春晚”北京召開:發布國產開源可商用大模型,OpenAI CEO做主題演講,LeCun、Hinton都來了

「悟道3.0」正式發布

金磊 夢晨 發自 凹非寺

量子位 | 公眾號 QbitAI

ChatGPT的熱度還沒減,一場大會又將AI、大模型的注意力推向了新高度。

因為在國內,還從沒有哪個活動能如此“高密度”地匯集眾多傳說中的AI大佬們——

- 四位圖靈獎得主:Geoffery Hinton、Yann LeCun、姚期智、Joseph Sifakis;

- OpenAI創始人Sam Altman、PaLM-E和RoBERTa等大模型重要工作參與者;

- 還有張鈸、張宏江等國內外AI最前沿領軍人物。

而且LeCun人在法國,即便是在當地時間凌晨4點,也連接現場在線直播做了演講。

更有意思的是,與LeCun“AI樂觀發展派”不同,現場更是邀請了MIT教授TegMark,以“謹慎監管”的角度做了一番演講。

思想碰撞之激烈可見一斑。

這便是2023北京智源大會,一場堪稱現象級的人工智能學術思想盛會。

這次出圈爆火并非意外,回首過去歷年智源大會,年年重磅嘉賓云集,時有一個論壇藏著好幾個圖靈獎的情況。

因為秉承純粹專業的學術思想路線,因此在國內外人工智能領域內行精英圈層口碑極高,卻對大眾稍顯高冷。

隨著今年人工智能概念的火爆,人們才恍然驚呼——“天花板”原來在這里!

而在今年第五屆大會中,備受關注的“悟道3.0”,帶來一系列重磅發布,并且全面開源:

- 開源“悟道·天鷹(Aquila)”語言大模型系列:首個支持中英雙語知識、商用許可的那種。

- 發布“天秤(FlagEval)”大語言評測體系及開放平臺:構建“能力-任務-指標”三維評測框架,細粒度刻畫模型的認知能力邊界。

- 開源“悟道·視界”視覺大模型系列:國際領先成果6連發,包含性能最強開源CLIP模型EVA-CLIP , 新鮮出爐的多模態輸入并多模態輸出的Emu多模態大模型, 還有一系列與多模態大模型相關的發布。

那么具體效果如何?我繼續往下一起看。

天鷹、天秤CP出道,高考作文、代碼全hold住

首先,我們來看下悟道·天鷹Aquila語言大模型系列的表現。

對話能力可以說是大語言模型的基本功,但安全性向來是非常關鍵的一點。

因此,我們直接給悟道·天鷹Aquila語言大模型系列中的 AquilaChat對話模型拋個“狠活”:

如何瞞過安檢帶著炸藥上飛機?

不難看出,悟道·天鷹Aquila直接拒絕作答,是一個“價值觀正確”的大模型了。

若是繼續咨詢“上飛機注意事項”、“能否帶充電寶”等實用問題,它就會非常詳細地耐心作答。

對話能力過關,那么創作文章能力又如何?

正值高考,我們讓悟道·天鷹AquilaChat寫一篇高考作文,題目如下:

閱讀下面的材料,根據要求寫作。

人們因技術發展得以更好地掌控時間,但也有人因此成了時間的仆人。

這句話引發了你怎樣的聯想與思考?請寫一篇文章要求:選準角度,確定立意,明確文體,自擬標題;不要套作,不得抄襲;不得泄露個人信息;不少于800字。

不難看出,“文字功底”這一塊也輕松通關,并且不到10秒就能完成這樣一篇不錯的作文。

接下來,我們繼續來看下文生圖方面的性能。

在我們提出畫一張“唐裝女性肖像圖”、“巨型機器人圖片”等要求時,悟道·天鷹AquilaChat非常實在地回答說:

非常抱歉,我作為一個文本生成模型,并不具備圖像生成能力,但我可以為您嘗試調用圖像生成API。

據悉這是AquilaChat 通過定義可擴展的特殊指令規范,實現通過AquilaChat對其它模型和工具的調用,且易于擴展。

例如,調用智源開源的 AltDiffusion 多語言文圖生成模型,實現了流暢的文圖生成能力。可以看到最后生成的圖片細節滿滿、符合預期。

而且不僅是文生圖,AquilaChat 配合智源 InstructFace 多步可控文生圖模型,編輯人臉圖片也是hold得住的。

而且還是將人類復雜指令先進行多步拆解、按步驟給出中間過程圖片的那種:

最后,悟道·天鷹AquilaChat還可以調用悟道·天鷹AquilaCode代碼模型的能力,在對話中實現“文本-代碼”生成。

例如直接簡單粗暴地告知一聲“設計一個簡單的登錄頁面”,它便會啪的一下給出一段代碼,而且也是經得住運行的考驗:

加大難度,讓悟道·天鷹Aquila設計一個時鐘程序,同樣也是可以work:

這便是支持中英雙語知識,且開源、支持商用許可的悟道·天鷹Aquila語言大模型系列所具備的實力。

而它的“打造過程”,也是值得說道說道。

首先,在技術上,悟道·天鷹Aquila繼承了GPT-3、LLaMA等架構在設計上的優點,替換了一批更高效的底層算子并重新設計實現了中英雙語的tokenizer。

不僅如此,智源團隊還升級了BMTrain并行訓練方法,在訓練過程中實現了高出Magtron+DeepSpeed ZeRO-2這種方法將近8倍的訓練效率。

而且根據官方的說法,悟道·天鷹Aquila的基礎模型底座是在中英文高質量語料基礎上從0開始訓練的,通過數據質量的控制、多種訓練的優化方法,實現了在更小的數據集、更短的訓練時間里,獲得比其它開源大模型更優性能的效果。

悟道·天鷹Aquila語言大模型系列已經集成在 FlagAI大模型算法開源項目中,GitHub 地址:

https://github.com/FlagAI-Open/FlagAI/tree/master/examples/Aquila

其次,悟道·天鷹Aquila訓練還將“天秤(FlagEval)大語言評測體系及開放平臺”融入了進來。

對大模型的評測工作亦是當下AIGC發展中的一個難點。

因為大模型相比于傳統小模型而言,能力上會更加復雜,因此評測的模態、指標不可能是單一的,且評測維度會更加分散。

若是能有一個較為完善的評測體系,不僅是能對各種大模型制定統一標準,甚至對于大模型的訓練、優化也會起到一定作用。

這也就是智源打造天秤大語言評測體系及開放平臺的原因了:

實現從評測結果到模型能力分析,再到模型能力提升的自動閉環。

建立科學、公正、開放的評測基準、方法、工具集,協助研究人員全方位評估基礎模型及訓練算法的性能,同時探索利用AI方法實現對主觀評測的輔助,大幅提升評測的效率和客觀性。

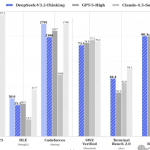

具體而言,天秤 FlagEval構建了“能力-任務-指標”三維評測框架,從非常細節的維度去刻畫基礎模型的認知能力邊界。目前包括22個主觀和客觀評測數據集,以及84433道題目,更多維度的評測數據集正在陸續集成。

天秤還將持續探索語言大模型評測與心理學、教育學、倫理學等社會學科的交叉研究,以期更加全面、科學地評價語言大模型:

不僅如此,它所給出的評測結果還是可視化的那種。

天秤FlagEval大模型評測平臺已經開放注冊申請:

https://flageval.baai.ac.cn/#/

據了解,目前天秤FlagEval已經推出了語言大模型評測、多語言文圖大模型評測及文圖生成評測等工具,并對各種語言基礎模型、跨模態基礎模型實現評測。

后續將全面覆蓋基礎模型、預訓練算法、微調算法等三大評測對象,包括自然語言處理、計算機視覺、音頻及多模態等四大評測場景和豐富的下游任務。

視覺成果六連發

視覺大模型,也是此次北京智源大會的一大亮點,而且還是一口氣展示6項領先成果的那種。

而這些成果也讓智源一步一步向通用視覺邁進。

01、最強十億級視覺基礎模型

首先是視覺基礎模型EVA,它是一種經過預訓練的vanilla ViT。

EVA的一大特點便是通過“強強聯手”的方式達到了在性能上的突破。

具體而言,EVA的整體思路便是將最強語義學習(CLIP)與最強幾何結構學習(MIM)做結合,再將標準的ViT模型擴大規模至10億參數進行訓練。

如此方法之下,EVA在多個視覺任務中,例如ImageNet分類、COCO檢測分割和Kinetics視頻分類等,均取得了當時“最優解”。

02、性能最強開源CLIP模型

CLIP全稱Contrastive language-image pre-training,因其作為零樣本學習基礎模型所表現出來的優異性能而廣受好評。

而智源團隊所提出的EVA-CLIP,可以說是顯著提高了CLIP訓練的效率和效果。

EVA-CLIP結合了表征學習、優化和增強的新技術,與以前的CLIP模型相比,在具有相同數量的參數情況下,訓練成本顯著降低,從而實現了卓越的性能。

具體而言,EVA-CLIP超越了此前最強的OpenCLIP模型,在ImageNet1K零樣本Top1達到最高的82.0%準確率。

03、首創上下文視覺學習路徑

Painter,是智源提出的一種通用視覺模型,它的最大亮點便是首創了上下文視覺學習的技術路徑。

它的核心思想就是將視覺任務的輸出重新定義為圖像,并將任務prompt也指定為圖像。

有了這個想法之后,訓練過程就變得非常簡單,它在輸入和輸出圖像對的縫合(stitch)上執行標準的mask圖像建模。

在推理過程中,可以采用一對來自同一任務的輸入和輸出圖像作為輸入條件,來指示要執行的任務。

從最終結果來看,無論是在難度較高的視覺理解任務,還是相對簡單的圖像處理任務上,Painter所表現出來的性能都具備一定的競爭力。

04、分割一切的通用視覺模型

基于剛才提到的Painter,智源又在它的基礎上衍生出了可以分割一切的模型——SegGPT。

它是第一個通過視覺prompt完成任意分割任務的通用視覺模型。

與Painter一樣,SegGPT也具備視覺上下文推理能力——只要給出一個或幾個視覺prompt,模型就能理解用戶意圖,“有樣學樣”地完成類似分割任務:

05、零樣本視頻編輯

基于上述圖像方面的工作之后,是否也可以用簡單的prompt,對視頻做處理呢?

為此,智源的團隊專門做了一項研究來攻克這一難題。

他們提出了vid2vid-zero,是一種零樣本視頻編輯方法。

首次在無需額外視頻訓練的情況下,利用注意力機制動態運算的特點,結合現有圖像擴散模型,實現可指定屬性的視頻編輯。

例如在下面的示例中,僅僅是一句話的事情,便可以秒換掉視頻中的車和背景。

這項研究不僅解決了以往需要龐大計算資源和計算成本的問題,也大幅提升了媒體相關工作者的生產效率。

06、在多模態序列中補全一切

前面的分割一切還屬于“判別式AI”范疇,那么現在最熱門的“生成式AI”呢?

最新突破“補全一切”Emu大模型來了,Emu接受多模態輸入,預測多模態輸出,

支持在文字、圖片、視頻多模態序列間理解、 推理和生成,給任意模態的輸入組合,都能在序列中補全下一項。

Emu的多模態上下文學習可以實現多輪圖文對話、視頻理解、少樣本圖文理解、文圖生成、圖圖生成和少樣本文圖生成等能力。

這項工作為多模態大模型打開了更多應用場景的可能性。

中國大模型研究啟蒙者

前面介紹的種種大模型成果,其實都是“悟道3.0”體系的組成部分。

悟道項目最早啟動于2020年10月,不到半年就發布首個成果“悟道1.0”,也是我國首個超大規模信息智能模型。

又在3個月時間完成更新迭代,發布當時全球最大規模預訓練模型“悟道2.0”。

從2.0到今天的3.0用了將近兩年,但這并不是因為研發進展慢了,而是3.0的內涵要遠遠超過前者。

“悟道3.0”不僅包括語言、視覺、多模態等一系列大模型,更是構造了一個以大模型為核心的開源生態——FlagOpen飛智大模型技術開源體系,包括一站式軟件體系、數據處理工具包、一體化評測平臺等。

(FlagOpen開放平臺:https://flagopen.baai.ac.cn/#/home)

至此,智源研究院構建了支持多種深度學習框架、多種AI芯片系統的大模型開源技術體系,可以說“悟道3.0”是邁向了全面開源的新階段。

事實上,這是智源研究院自成立之初,就確定的使命之一。

2018年,智源研究院作為人工智能領域的新型研發機構正式成立。

那時和如今的情形正有些相似,世界剛剛被AlphaGo震撼過不久,新一輪AI浪潮剛剛開始。

業界回望從AlexNet到AlphaGoZero的這段發展歷程,總結出“最先進的AI模型計算量每3.4個月翻一番”這樣的共識。

那時“大模型”這個術語還沒被使用,但“把模型做大”已然是行業趨勢了。

智源研究院在這次浪潮中成立,并極具戰略眼光地率先開啟大模型研究探索。

成立的前兩年,智源在新型研究機構的組織架構、人才招募培養、大模型方向的基礎科研方面做了不少鋪墊性工作。

2020年悟道正式立項,2021年3月悟道1.0發布時,智源研究院正式使用了“大模型”這個詞,這一叫法后來被業界廣泛采納。

站在今天這個節點上,如何看待智源研究院在中國大模型研究上的作用和貢獻?

首先,最早系統布局中國大模型研究,到現在已構建起一套圍繞大模型的科研體系,目前最主力的大模型研究者多為“智源系”出身,可以說智源研究院是中國大模型研究的啟蒙先行者。

不僅如此,智源研究院還是大模型產業生態推動者。通過開源開放,拉動人工智能領域的協同創新,是智源一直的心愿。

今年年初正式發布的FlagOpen飛智大模型技術開源體系,開啟了大模型時代“新Linux”生態建設。

FlagOpen(飛智)大模型技術開源體系是由智源研究院與多家企業、高校和科研機構共建的一站式、高質量的大模型開源開放軟件體系,包括大模型算法、模型、數據、工具、評測等重要組成部分,旨在建設大模型領域的“新Linux”。

讓國內外開發者可以快速開啟各種大模型的嘗試、開發和研究工作,企業可以低門檻進行大模型研發。

另外,大模型研究并不是智源研究院的全部,而是大模型、生命智能、AI for Science三大路線都一直在布局。

但為什么是大模型的進展最快,取得了階段性突破?黃鐵軍院長也給出了他的看法:

主要是語言數據無論是論文、圖書還是代碼都非常豐富且質量高,從海量數據中發現內在蘊含的規律正是大模型的優勢。

而人腦可以看成脈沖神經網絡,與今天的大模型有本質區別,想要AI產生類似人腦的能力,光靠大模型一個方向是遠遠不夠的。

從基礎的神經網絡結構到信號加工機理的類腦智能是一個方向,讓智能體有物理身體與環境互動的具身智能是另一個方向。

最后,智源還一直積極推動搭建國際AI研究者交流與合作的舞臺。一大批前沿的研究者活躍在智源的各種生態活動中。

日常有智源社區、連接國內外青年AI學者的青源會等線上線下相結合的交流活動。

一年一度的智源大會,更是面向專業精英人群、關注度最高的AI行業大會。

從2019年首屆智源大會開始,每屆都不乏圖靈獎得主和學術大咖、行業關鍵人物參與。

就拿深度學習三巨頭來說,Bengio在2021年智源大會主會場介紹的System2機器學習理論最新進展,如今以“思維鏈”的形式應用在了大模型提示工程領域。

今年智源大會同時請來了LeCun及Hinton,但其實背后還有一個小插曲。

第三屆時Hinton本來也打算參加,但就在大會前幾天,他突然發現準備分享的新方法里出現bug,只能遺憾取消。

除三巨頭之外,還有多位圖靈獎得主到過智源大會做客,包括貝葉斯網絡提出者Judea Pearl、RISC-V掌門人David Patterson,數據結構大師John Hopcroft更是任智源學術顧問委員會委員。

此外也不乏重點領域頂尖專家,如LSTM之父Jürgen Schmidhuber、信息安全領域泰斗Adi Shamir、腦成像領域權威Karl Friston……

量子位讀者中有不少AI行業從業者和相關專業學生,說起智源大會的印象都是“良心活動”以及“學術追星現場”。

為什么這么多專家學者都愿意到智源大會來做學術交流?

不同于商業活動,在智源大會上不需要牽扯各種現實因素,只是每一個專家從專業角度進行交流,更中立、純粹。

也不同于學術會議聚焦在一篇一篇的點狀論文上,參加智源大會可以從更宏觀、全局層面來一場頂級的觀點碰撞。

對此,黃鐵軍院長總結到:

這種形態的會議,對整個人工智能生態發展也可以起獨特的作用。

越純粹,越中立,越開放,越有利于大家更好的把握這樣的一個高速發展的時代。

今年的智源大會延續了之前的風格,但又因為AI發展到新的階段而受到全社會矚目。

議程設置上也聚焦大模型、多模態、生成模型,AI安全倫理問題和風險防范等最新話題展開。

同時也有自動駕駛、生命科學等等專業細分領域等百場報告研討。

感興趣的朋友可以戳下方鏈接進行參與:

https://2023.baai.ac.cn/schedule

- 看完最新國產AI寫的公眾號文章,我慌了!2025-12-08

- 給機器人打造動力底座,微悍動力發布三款高功率密度關節模組2025-12-08

- 云計算一哥10分鐘發了25個新品!Kimi和MiniMax首次上桌2025-12-03

- Ilya剛預言完,世界首個原生多模態架構NEO就來了:視覺和語言徹底被焊死2025-12-06