DeepMind丟掉了歸一化,讓圖像識別訓練速度提升了8.7倍 | 已開源

在ImageNet上拿到了SOTA

金磊 發自 凹非寺

量子位 報道 | 公眾號 QbitAI

在大規模圖像識別任務上,DeepMind的新方法火了。

不僅拿到了SOTA,訓練速度還提升了8.7倍之多!

方法關鍵:去“批處理歸一化”

對于大多數圖像識別模型來說,批處理歸一化(batch normalization)是非常重要的組成部分。

但與此同時,這樣的方式也存在一定的局限性,那就是它存在許多并不重要的特征。

雖然近期的一些研究在沒有歸一化的情況下,成功訓練了深度ResNet,但這些模型與最佳批處理歸一化網絡的測試精度不相匹配。

而這便是DeepMind此次研究所要解決的問題——提出了一種自適應梯度剪裁(AGC)?技術。

具體而言,這是一種叫做Normalizer-Free ResNet?(NFNet)的新網絡。

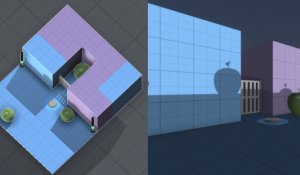

整體來看,NFNet的整體結構如上圖所示。

以有無“transition塊”來劃分,可以再細分為2種情況。

其中,它們的bottleneck ratio均設置為0.5,且在3 x 3的卷積中,無論信道的數量為多少,組寬都固定為128。

二者的區別在于skip path接收信號的方式,左側的是在用β進行variance downscaling和縮放非線性之后;而右側則是在用β進行variance downscaling之前完成。

實驗結果

在實驗部分,DeepMind的研究人員,采用了與NFNet相關的7個模型做了對比實驗,分別是NFNet-F0至NFNet-F6。

不難看出,在各個模型的對比過程中,在Top-1精度方面均取得了最好結果。

值得一提的是,與EfficientNet-B7相比,訓練速度方面提升了8.7倍之多。

此外,在對3億張標記圖像進行大規模預訓練后,在ImageNet上還取得了89.2%的Top-1精度。

最后,對于這項研究的代碼,也已在GitHub上開源。

傳送門

論文地址:

https://arxiv.org/abs/2102.06171

代碼地址:

https://github.com/deepmind/

- 戴爾 x OpenCSG,推出?向智能初創企業的?體化 IT 基礎架構解決方案2025-12-10

- 看完最新國產AI寫的公眾號文章,我慌了!2025-12-08

- 共推空天領域智能化升級!趨境科技與金航數碼強強聯手2025-12-09

- Ilya剛預言完,世界首個原生多模態架構NEO就來了:視覺和語言徹底被焊死2025-12-06