近日,2022 IEEE 國際計算機視覺與模式識別會議(IEEE Conference on Computer Vision and Pattern Recognition,簡稱 CVPR)公布論文收錄結果。據 CVPR 官網顯示,共收到全球范圍內 8186 篇有效投稿,其中火山引擎論文《Dressing in the Wild by Watching Dance Videos》(《基于跳舞視頻的通用虛擬換裝》)成功入選。

CVPR 已是計算機視覺和模式識別領域的全球頂級學術會議。根據谷歌學術公布的2021年最新學術期刊和會議影響力排名,CVPR在所有學術刊物中,影響力僅次于 Nature、NEJM 和 Science。

此次被收錄的最新研究成果涵蓋了計算機視覺的各項前沿工作。火山引擎被收錄的論文提出了 wFlow (flow in-the-wild)技術方案,首次解決真實用戶場景下的虛擬換裝問題。該方案通過 2D 和 3D 信息的結合,可以兼容圖片中復雜的人體姿勢,背景和服裝類型,包括寬松不貼身服裝(如連衣裙),同時保持換裝結果圖片的高清晰度和真實性。

另外,此方案通過一種自監督訓練的方式,通過公開可用的人物跳舞視頻(經脫敏處理)作為訓練數據來實現虛擬換裝神經網絡模型的訓練,避開了難以獲得換裝結果圖作為直接監督的難題。論文中火山引擎構建的 dance50k 數據集后續也將公開供學術界使用。

基于跳舞視頻的通用虛擬換裝

在娛樂和電商領域,虛擬換裝問題有著比較好的落地前景。虛擬換裝,簡單來說就是在沒有實際的人物和衣服的情況下,直接通過算法將參考圖片上的衣服,遷移到另一個用戶圖片中的人身上,從而生成真實的試穿圖片。

由于缺乏對人體潛在的 3D 信息感知能力及相應的多樣化姿態-衣服數據集,學術界此前很難處理好實際真實用戶場景下的數據,只能在一些固定分布的數據集上有相對好的效果。現有的虛擬換裝工作局限于簡單人體姿勢及貼身衣物,極大地限制了其在真實場景下的應用能力。

在 2020 年上半年,火山引擎開始對虛擬換裝技術做長線規劃并開始長期投入,首次將 2D 像素流與 3D 頂點流相結合形成更為通用的外觀流預測模塊 (命名為 wFlow),在解決寬松衣服變形的同時提升對復雜人體姿勢的適應力。

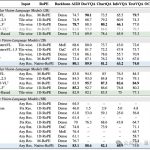

具體來說,2D 像素流負責構建衣物圖片與人體分割圖之間的紋理映射關系,其對圖片層面的空間結構特征敏感但無法復現潛在 3D 人體的剛性變換,通過進一步引入基于 SMPL 人體 3D 模型的頂點流,通用復合外觀流 wFlow 相較現有工作的單一外觀流具備更強的三維感知力,同時不丟失了對目標衣服完整 2D 空間結構的保留能力,下圖展示了 wFlow 與其他 SOTA 虛擬試穿方法的對比結果。

相較現有工作需要大量人工采集成對衣服-人物數據集進行模型訓練,火山引擎通過在跳舞視頻上直接進行跨幀自監督訓練并對復雜例子進行在線環式優化,實驗證明 wFlow 相較現有的單一像素或者頂點外觀流方法在真實世界圖片上泛化性更高。

可以說,wFlow (flow in-the-wild)技術方案,相比現有方案有更好的視角效果和客觀圖像質量評估指標,有效提升了虛擬換裝的普適性。

論文中,火山引擎新提出的大規模視頻數據 Dance50k 相較現有被廣泛使用的 DeepFashion 數據集在衣服種類及圖片數量上均有大幅提升(見下圖)。

同時,火山引擎決定將構建的大規模人物視頻數據集共享給學術界使用,以期促進虛擬換裝及其他以人為中心的圖像生成研究。

未來,AI 技術將越來越多地應用于貫穿 B 端商家與 C 端消費者的整條業務鏈路,例如在短視頻和電商領域:

- 為短視頻特效道具提供技術基礎,實現一鍵換裝的短視頻特效。用戶可以穿著各式各樣的服裝進行短視頻創作,激發創作欲望,豐富后置攝像頭的視頻創作生態;

- 幫助電商環境下,用戶服裝選購實現線上試衣,甚至幫助商家生成高質量模特服裝展示圖,節省成本。

除此之外,火山引擎自研了頭部、耳部、足部、手部、腕部、頸部、身體等業內最全面的端上實時人體 3D 感知能力,支持 10 余類商品的實時試穿試戴,提供全平臺統一的虛擬試穿試戴解決方案。

疫情當前,線上消費場景需求更多元,AR 虛擬體驗成為促進體驗式消費升級的重要一環。對于用戶來說,能夠直接在線上進行商品試用,有助于提升用戶的線上消費體驗,從而促進商品的購買轉化;對于品牌方來說,提供線上的商品及品牌特效互動的能力,這對于品牌推廣及購買轉化率,都有重要的意義。

借助落地的 wFlow 技術方案,火山引擎開放技術,擁抱合作,希望幫助更多行業用戶打造新的營銷玩法,實現業務增長。