首個(gè)沉浸式體積視頻數(shù)據(jù)集ImViD上線,定義沉浸式媒體新形態(tài)丨CVPR25 Highlight

“體積視頻技術(shù)”讓大眾看到元宇宙的曙光

當(dāng)Meta用天價(jià)堆砌「元宇宙」卻困在卡通畫風(fēng),當(dāng)Vision Pro用戶為3-DoF的“電子櫥窗”眩暈買單,當(dāng)影視巨頭砸千萬搭建穹頂攝影棚卻只能產(chǎn)出“人像手辦”……

猛然發(fā)現(xiàn)——沒有高保真體積視頻的元宇宙,不過是高清版的《我的世界》。

今天為大家?guī)砬迦A大學(xué)-咪咕團(tuán)隊(duì)發(fā)表于CVPR 2025的最新工作《ImViD: Dynamic Volumetric Video Reconstruction and Rendering for Immersive VR》。

作者用360°真實(shí)光場(chǎng)+多模態(tài)6-DoF自由漫游,將VR體驗(yàn)從“隔著玻璃看展”推向“穿越時(shí)空的在場(chǎng)感”。

背景與挑戰(zhàn):我們距離高逼真的數(shù)字世界還有多遠(yuǎn)?

隨著Meta Quest和Apple Vision Pro等VR頭顯的興起,人們對(duì)沉浸式體驗(yàn)的需求愈發(fā)強(qiáng)烈。然而,傳統(tǒng)2D視頻或靜態(tài)3D模型始終難以突破“真實(shí)感”的桎梏,最新的技術(shù)也面臨著“形似神離”的困境:

● 2019年Google提出沉浸式光場(chǎng)(Immersive Light Field),雖支持6-DoF交互,但受限于固定機(jī)位的拍攝方式,僅覆蓋場(chǎng)景的正面視角,交互范圍有限,且缺乏多模態(tài)數(shù)據(jù);

● 2022年 Apple 提出沉浸式視頻(Immersive Video),雖以高分辨率和環(huán)繞式立體聲著稱,但僅提供3-DoF的觀看體驗(yàn),缺少空間位置的交互自由度。此外,這種呈現(xiàn)方式無法提供真實(shí)場(chǎng)景的深度感知,導(dǎo)致視覺系統(tǒng)與前庭感知的沖突,用戶在長(zhǎng)時(shí)間觀看后易產(chǎn)生眩暈和疲勞;

● 2024年 Infinite Reality 推出的空間捕獲技術(shù)(Spatial Capture),通過穹頂式“由外向內(nèi)(Outside-looking-in)”的采集方案實(shí)現(xiàn)了高分辨率、高真實(shí)感的動(dòng)態(tài)場(chǎng)景建模。然而,受限于封閉式硬件架構(gòu),僅能針對(duì)狹小空間內(nèi)以人或物體為中心的局部場(chǎng)景進(jìn)行捕捉,缺乏復(fù)雜背景細(xì)節(jié)與自然光照,且設(shè)備部署復(fù)雜、成本高昂,難以拓展至開放環(huán)境或大規(guī)模商業(yè)應(yīng)用。

圖注:沉浸式媒體形式的分類及發(fā)展方向示意圖:體積視頻是順應(yīng)時(shí)代信息升維的產(chǎn)物,有望成為未來的主流媒體形式。

如何打破瓶頸?

清華-咪咕團(tuán)隊(duì)聯(lián)合推出“沉浸式體積視頻(Immersive Volumetric Video)”概念,從四個(gè)維度突破傳統(tǒng)體積視頻的局限:

1. 全視角:360°真實(shí)場(chǎng)景。團(tuán)隊(duì)實(shí)現(xiàn)動(dòng)態(tài)前景+復(fù)雜背景完整覆蓋,突破固定空間拍攝限制;

2. 大空間:大范圍6-DoF交互。可移動(dòng)拍攝車擴(kuò)大采集范圍,支持用戶六自由度自由探索每一處細(xì)節(jié);

3. 多模態(tài):光聲同步采集。5K@60FPS視頻+同步音頻采集,高保真光聲場(chǎng)融合重建,視聽反饋隨動(dòng)無延遲;

4. 長(zhǎng)時(shí)長(zhǎng):長(zhǎng)時(shí)間高幀率內(nèi)容。1-5分鐘高清動(dòng)態(tài)光場(chǎng)內(nèi)容告別“片段式”體驗(yàn)!

該工作構(gòu)建了一套完整的生產(chǎn)管線:從系統(tǒng)搭建、采集策略設(shè)計(jì)、光/聲場(chǎng)融合重建,到最終高保真實(shí)時(shí)渲染交互。 為下一代 VR 沉浸內(nèi)容提供基準(zhǔn)數(shù)據(jù)與方法參考。

相關(guān)成果發(fā)表于國際計(jì)算機(jī)視覺頂級(jí)會(huì)議IEEE CVPR 2025并入選為Highlight(亮點(diǎn)工作)。

圖注:[CVPR 2025 Highlight] ImViD: Dynamic Volumetric Video Reconstruction and Rendering for Immersive VR

核心貢獻(xiàn):ImViD——沉浸式體積視頻全流程制作管線

圖注:ImViD沉浸式體積視頻構(gòu)建方法總覽:采集 – 預(yù)處理 – 光場(chǎng)重建 – 聲場(chǎng)建模 – 渲染

團(tuán)隊(duì)推出全球首個(gè)面向大空間的多模態(tài)體積視頻數(shù)據(jù)集ImViD以支持用戶可自由移動(dòng)的完全沉浸式體驗(yàn),為體積視頻的研究和應(yīng)用提供了新的路徑:

● 硬件革新:自搭建46臺(tái)GoPro相機(jī)陣列+可移動(dòng)拍攝車,模擬人類視角的觀看習(xí)慣,高效高密度覆蓋采集空間;

● 數(shù)據(jù)規(guī)模:7大開放世界真實(shí)室內(nèi)外場(chǎng)景(歌劇、會(huì)議、教學(xué)等),5K分辨率+60FPS,總時(shí)長(zhǎng)超38分鐘,13萬幀;

● 動(dòng)態(tài)捕捉:支持靜態(tài)定點(diǎn)與動(dòng)態(tài)移動(dòng)雙模式拍攝,首次實(shí)現(xiàn)“邊走邊拍”的多視角高密度時(shí)空光場(chǎng)采集;

● 開放挑戰(zhàn):所有動(dòng)態(tài)場(chǎng)景數(shù)據(jù)公開,推動(dòng)沉浸式體積視頻算法與應(yīng)用突破!

三、ImViD系統(tǒng)搭建與數(shù)據(jù)采集

團(tuán)隊(duì)設(shè)計(jì)并搭建了一個(gè)可遠(yuǎn)程控制的移動(dòng)式平臺(tái),搭載 46 臺(tái)GoPro 攝像機(jī)同步觸發(fā),可實(shí)現(xiàn)高效光、聲場(chǎng)采集:

數(shù)據(jù)采集方案:可移動(dòng)式平臺(tái) + 多種拍攝模式

● 多視角同步音視頻采集(分辨率 5312×2988, 60FPS, 1-5 min);

● 定點(diǎn)采集 + 移動(dòng)軌跡拍攝模式(支持背景重建與動(dòng)態(tài)前景追蹤);

● 毫米級(jí)相機(jī)陣列時(shí)間同步機(jī)制。

數(shù)據(jù)集內(nèi)容與參數(shù)指標(biāo)展示

數(shù)據(jù)集中包括了各式各樣的生活常見室內(nèi)外動(dòng)態(tài)場(chǎng)景,具有豐富的前背景,涵蓋了慢速運(yùn)動(dòng)和快速運(yùn)動(dòng)的內(nèi)容,對(duì)當(dāng)前重建算法提出了更高的要求,能進(jìn)一步挖掘算法的瓶頸,促進(jìn)社區(qū)的進(jìn)步。

四、ImViD光聲場(chǎng)融合重建

動(dòng)態(tài)光場(chǎng)重建:

作者在 Spacetime Gaussian (STG) 的基礎(chǔ)上,提出了時(shí)空一致性更強(qiáng)的改進(jìn)方法 STG++,解決了原方法在動(dòng)態(tài)場(chǎng)景下的漂移與色差問題。

為了消除多相機(jī)之間的色彩差異,STG++ 為每個(gè)相機(jī)引入仿射顏色變換:

該變換在渲染損失中被聯(lián)合優(yōu)化,以確保多視角顏色對(duì)齊。此外,作者還在重建過程中對(duì)時(shí)間維度執(zhí)行了致密化操作,讓高斯在時(shí)間維度上也可控。

自由聲場(chǎng)重建:

作者提出一種不依賴神經(jīng)網(wǎng)絡(luò)訓(xùn)練的幾何驅(qū)動(dòng)聲場(chǎng)建模方法,基于 HRTF(頭相關(guān)傳遞函數(shù))和 RIR(房間脈沖響應(yīng))進(jìn)行空間音頻渲染。具體步驟如下:

(1)聲源定位:通過麥克風(fēng)陣列獲取聲源位置與用戶耳朵位置;

(2)距離衰減建模:計(jì)算聲源到用戶耳朵的距離衰減;

(3)空間音頻渲染:基于 HRTF 和 RIR 進(jìn)行空間音頻渲染。 從多個(gè)同步相機(jī)采集的音視頻數(shù)據(jù)構(gòu)建聲場(chǎng)的方案在國內(nèi)外鮮有團(tuán)隊(duì)嘗試,但這類采集方式非常貼近人們?nèi)粘E臄z生活場(chǎng)景的習(xí)慣,因此該團(tuán)隊(duì)提出的方案具有極大的推廣價(jià)值。

實(shí)驗(yàn)結(jié)果:STG++領(lǐng)跑,聲場(chǎng)融合,沉浸感拉滿!

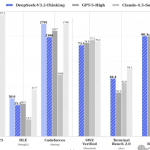

● 光場(chǎng)重建:改進(jìn)算法STG++以31.24 PSNR、110 FPS刷新性能,解決色彩閃爍與運(yùn)動(dòng)斷層難題;

圖注:論文結(jié)果展示(一)

● 聲場(chǎng)合成:用戶研究顯示,61.9%專家認(rèn)為空間音頻感知“優(yōu)秀”,90%認(rèn)可沉浸感;

圖注:論文結(jié)果展示(二)

● 實(shí)時(shí)交互:?jiǎn)慰?090實(shí)現(xiàn)6-DoF多模態(tài)VR體驗(yàn),60FPS絲滑渲染,視聽反饋隨動(dòng)無延遲!

圖注:論文結(jié)果展示(三)

未來展望:打開數(shù)字孿生與元宇宙的大門

ImViD不僅為學(xué)術(shù)界提供全新基準(zhǔn),更在影視、教育、醫(yī)療等領(lǐng)域展現(xiàn)潛力:

● 動(dòng)態(tài)光場(chǎng)重建:推動(dòng)長(zhǎng)時(shí)復(fù)雜場(chǎng)景的高效建模;

● 聲場(chǎng)合成:無需訓(xùn)練數(shù)據(jù),支持移動(dòng)聲源定位,非常適合日常記錄(Causal Capture);

● 產(chǎn)業(yè)落地:助力智慧醫(yī)療、教育、遠(yuǎn)程協(xié)作,智慧文旅如虛擬演唱會(huì)、景點(diǎn)游覽等應(yīng)用場(chǎng)景。同時(shí)將支持移動(dòng)端交互渲染,讓4D視頻具有更多可能。

項(xiàng)目主頁:https://yzxqh.github.io/ImViD/

論文地址: https://arxiv.org/pdf/2503.14359

論文/代碼/數(shù)據(jù):全面開源,歡迎挑戰(zhàn)!(持續(xù)更新中)

致謝:

本研究獲國家重點(diǎn)研發(fā)計(jì)劃、國家自然科學(xué)基金、清華-咪咕智能光場(chǎng)與交互技術(shù)聯(lián)合研究中心和北京市光場(chǎng)共性技術(shù)平臺(tái)支持。

- 視頻理解霸榜!快手Keye-VL旗艦?zāi)P椭匕蹰_源,多模態(tài)視頻感知領(lǐng)頭羊2025-11-28

- 中國唯一!阿里千問斬獲全球AI頂會(huì)最佳論文2025-11-28

- 第19屆中國投資年會(huì)·有限合伙人峰會(huì)在滬成功舉辦2025-11-28

- C++之父親臨北京,AI 原生時(shí)代最值得參加的系統(tǒng)軟件技術(shù)大會(huì)日程發(fā)布2025-11-28