LeCun最新訪談:距離AGI可能不到10年,下一代AI需要情感和視覺訓(xùn)練

Llama要做AI界的Linux

奇月 發(fā)自 凹非寺

量子位 | 公眾號 QbitAI

語言模型的發(fā)展已很難有大的突破了。

這是LeCun最新訪談中給出的斷言。

頭戴Meta爆火智能眼鏡,LeCun再次表示人類距離AGI的時(shí)間沒有那么近,“大約在5-10年”,對語言模型發(fā)展的判斷更是不樂觀。

未來在哪?還是得看世界模型。

未來AI需要情感、視覺訓(xùn)練,能夠理解物理環(huán)境的世界模型。

而AI發(fā)展的關(guān)鍵是啥?開源,Llama之于AI就像是Linux之于互聯(lián)網(wǎng)。

如果Llama未來可以發(fā)展成一個(gè)全球的、分布式的AI計(jì)算平臺,可以大大促進(jìn)AI的發(fā)展。

此次訪談在約翰霍普金斯大學(xué)布隆伯格中心進(jìn)行,主持人是Vox Media的卡拉·斯威舍(Kara Swisher)。

在不改變原意的前提下,量子位對訪談的重點(diǎn)內(nèi)容進(jìn)行了梳理。

更智能的AI需要情感和視覺能力

Q:你獲得了2024年Vin未來獎(jiǎng),在獲獎(jiǎng)感言中你提到,AI的學(xué)習(xí)方式不像人類或動物,它們沒有從物理世界中獲取大量的視覺觀察,但你一直在努力實(shí)現(xiàn)這一點(diǎn)。

LeCun:我們將會有一些系統(tǒng),它們會像人類和動物一樣高效地學(xué)習(xí)新技能和新任務(wù),目前我們還無法用機(jī)器復(fù)制這一點(diǎn)。

我們無法制造出足夠聰明的家用機(jī)器人,原因很簡單,因?yàn)槲覀冇?xùn)練的LLM和機(jī)器人都是基于所有公開可用的文本,大約有20萬億個(gè)單詞,每個(gè)單詞大約由三個(gè)字節(jié)表示,所以大約是6乘以10的14次方個(gè)單詞。

心理學(xué)家會告訴你,一個(gè)四歲的孩子總共醒著的時(shí)間是16000小時(shí),視覺信息以每秒大約2兆字節(jié)的速度進(jìn)入孩子的大腦。我們來算一下,我們有100萬到200萬根視神經(jīng)纖維,每根每秒大約攜帶一個(gè)字節(jié),我們有兩只眼睛,所以大約是每秒2兆字節(jié)。

這樣計(jì)算,16000小時(shí)就是10的14次方字節(jié),這與最大的LLM通過文本看到的數(shù)據(jù)量相同。我們要花上幾萬年才能讀完這些文本。這告訴我們,我們永遠(yuǎn)不會僅僅通過訓(xùn)練文本達(dá)到人類水平的AI,我們必須訓(xùn)練感官輸入。

基本上,視覺輸入是無限的,16000小時(shí)的視頻大約是YouTube上30分鐘上傳的視頻總時(shí)長。我們擁有的視頻數(shù)據(jù)比我們能處理的要多得多。因此,未來幾年AI要取得下一個(gè)級別的進(jìn)步,最大的挑戰(zhàn)就是讓系統(tǒng)通過觀看視頻并互動來理解世界是如何運(yùn)作的。

這個(gè)問題還沒有解決,但我認(rèn)為在接下來的五年里,很有可能取得重大進(jìn)展,這就是為什么你會看到所有這些公司開始制造人類機(jī)器人。他們還造不出足夠聰明的機(jī)器人,但他們相信在未來五年內(nèi)AI會取得足夠的進(jìn)步,到時(shí)候這些機(jī)器人就可以賣給公眾了。

我們設(shè)想在未來幾年的構(gòu)建藍(lán)圖中,AI系統(tǒng)將具有情感,這是這些系統(tǒng)設(shè)計(jì)的基本組成部分。為什么它們會有情感呢?因?yàn)樗鼈儗?strong>由目標(biāo)驅(qū)動,你給它們一個(gè)必須完成的任務(wù),它們的目的是在硬編碼到它們設(shè)計(jì)中的約束條件下完成這個(gè)任務(wù)。

為了做到這一點(diǎn),它們需要幾個(gè)組件。首先,它們需要一種方法來確定我們給它們的目標(biāo)是否已經(jīng)完成。此外,它們還需要一個(gè)我們稱之為世界模型的東西,這是我們所有人在前額葉皮層中都有的東西,它允許我們想象我們行為的后果是什么,它讓我們能夠規(guī)劃一系列行動來完成一個(gè)特定的目標(biāo)。

如果你有能力提前預(yù)測一系列行動將產(chǎn)生什么,那么你就可以預(yù)測一個(gè)目標(biāo)是否會得到滿足,以及預(yù)測結(jié)果會是好是壞。如果你預(yù)測結(jié)果會很糟糕,你會感到恐懼;如果你預(yù)測結(jié)果會很好,你會感到興奮。所以,預(yù)測然后行動以完成這些預(yù)測的能力,產(chǎn)生了相當(dāng)于情感的東西。

因此,足夠聰明的AI系統(tǒng),能夠推理和規(guī)劃并擁有世界模型的AI系統(tǒng),將具有情感。

Q:這將產(chǎn)生廣泛的影響,可能會改變學(xué)習(xí)方式,改變一切,讓每個(gè)人都相處得更好。但是,仇恨、功能障礙、孤獨(dú)等問題仍然存在,你怎么看待這些事情?

LeCun:我不是億萬富翁,我首先是一名科學(xué)家,如果沒有某種程度的科學(xué)誠信,我無法面對鏡子中的自己。科學(xué)的全過程就是你必須接受你可能會錯(cuò)的事實(shí),正確的想法來自于多種觀點(diǎn)的碰撞和不同意的人。

我們看看現(xiàn)實(shí),人們說AI會摧毀社會,因?yàn)槲覀儠涑庵摷傩畔⒑蜕傻某鸷扪哉摰鹊龋覀兏緵]有看到這種情況。事實(shí)上,人們制造仇恨言論,制造虛假信息,他們試圖以各種方式傳播,但我們最好的防御措施就是AI系統(tǒng)。

我們需要的是更多的AI技術(shù)掌握在好人手中,而不是壞人手中。

語言模型很難再提升,未來每個(gè)人都會有AI助手

Q:你剛才說自回歸LLM正在達(dá)到性能上限,下一代人工智能系統(tǒng)和大語言模型有什么不同?

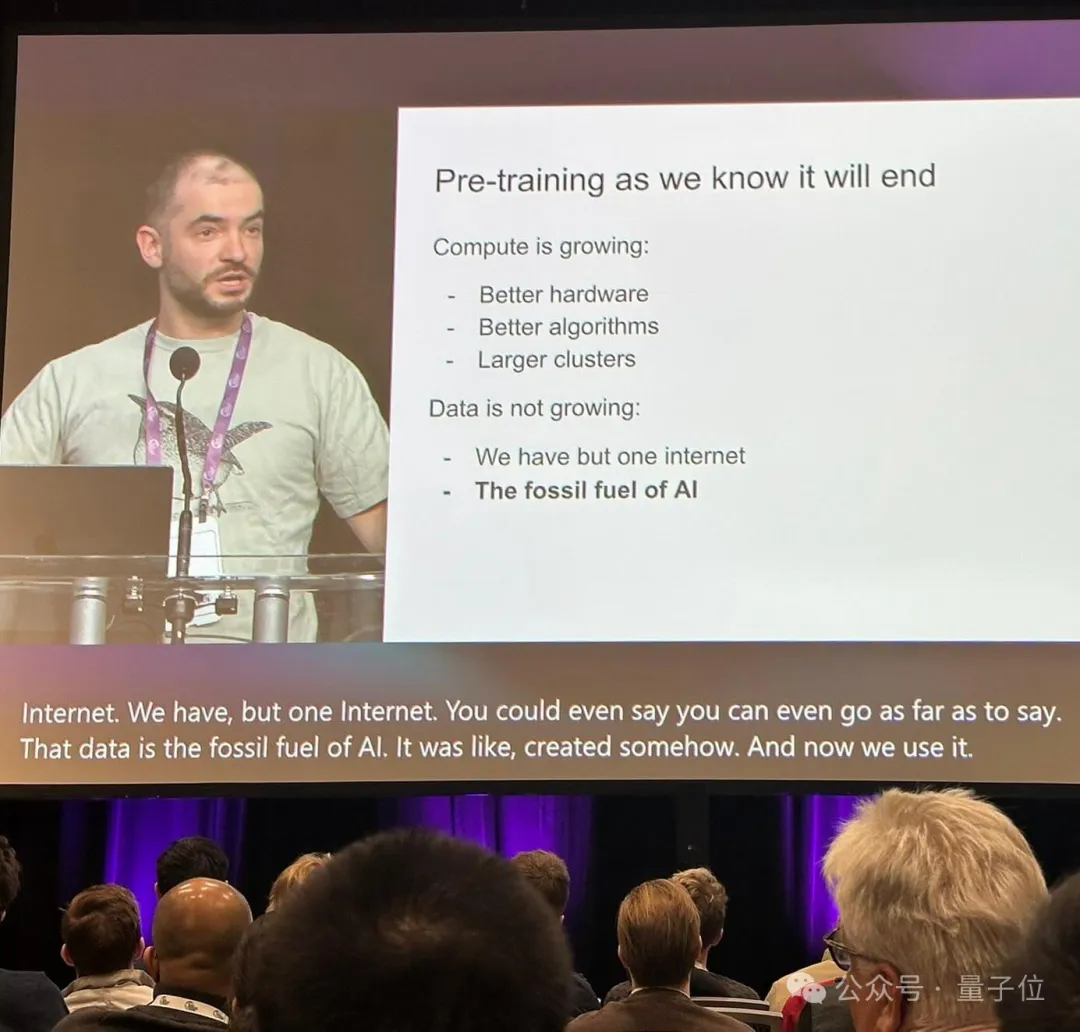

LeCun:過去有些人認(rèn)為,像GPT這樣的LLM,只要擴(kuò)大規(guī)模,在更多的數(shù)據(jù)上進(jìn)行訓(xùn)練,用更多的計(jì)算能力,人類水平的智能就會從中產(chǎn)生。我從來不相信這個(gè)概念。llya曾經(jīng)是這個(gè)概念的著名信徒,不過他也放棄了。

這些系統(tǒng)的性能已經(jīng)達(dá)到了上限,因?yàn)槲覀兓旧弦呀?jīng)用盡了所有公開可用的文本數(shù)據(jù)來訓(xùn)練這些LLM,不可能再得到比這更多的數(shù)據(jù)了。所以人們開始生成合成數(shù)據(jù)之類的東西,但這樣不可能將性能提高10倍或100倍。

LLM被稱為大型語言模型,因?yàn)樗旧鲜潜挥?xùn)練來預(yù)測文本中的下一個(gè)單詞,這些系統(tǒng)實(shí)際上是在預(yù)測單詞的概率分布,你可以用它來生成文本。這就是自回歸部分。

但無法保證所產(chǎn)生的單詞序列會有意義,有可能會產(chǎn)生胡言亂語或編造東西。所以很多行業(yè)都在努力尋找一種方法,基本上是通過人類參與來訓(xùn)練系統(tǒng),讓它們執(zhí)行特定任務(wù)而不產(chǎn)生無意義的內(nèi)容。

我們正在研究的是下一代人工智能系統(tǒng),它不僅僅基于預(yù)測下一個(gè)單詞。

當(dāng)它們不知道答案時(shí),它們可以查詢數(shù)據(jù)庫或搜索引擎。你需要有能夠檢測系統(tǒng)是否知道答案的系統(tǒng),然后可能生成多個(gè)答案,然后你知道挑選哪些答案是好的。

Q:上周Meta發(fā)布了Meta?Motivo,它可以制造看起來更像活人的數(shù)字人。這好像是在嘗試讓元宇宙再次成為現(xiàn)實(shí),你能告訴我它到底是什么嗎?因?yàn)槟銈冊谶@些事情上投入了大量資金。

LeCun:我現(xiàn)在正戴著智能眼鏡,我們最終將圍繞智能眼鏡或其他智能設(shè)備展開工作,它們將配備人工智能助手,我可以通過它跟AI交流。這些設(shè)備將在我們的日常生活中協(xié)助我們,我們希望這些系統(tǒng)具有人類水平的智能水平,甚至在許多方面具有超人的智能水平。

但我們離那個(gè)目標(biāo)還很遠(yuǎn)。不是幾個(gè)世紀(jì),也可能不是幾十年,但可能是幾年。LLM可以通過律師考試,或者通過一些大學(xué)考試。但家用機(jī)器人還不能完全打掃房子,清理餐桌,洗碗。我們不是不能制造機(jī)器人,而是無法讓它們足夠聰明、讓它們理解物理世界。事實(shí)證明,物理世界對AI系統(tǒng)來說要復(fù)雜得多。

這些系統(tǒng)最終將能夠規(guī)劃一系列行動以實(shí)現(xiàn)特定目標(biāo),這就是我們所說的Agent。一個(gè)Agent系統(tǒng)是一個(gè)可以規(guī)劃一系列行動以達(dá)到特定結(jié)果的系統(tǒng)。現(xiàn)在大家談?wù)摰拇硐到y(tǒng)實(shí)際上并沒有這樣做。

Q:Meta還在開發(fā)AI搜索引擎,我猜你們是想超越谷歌搜索?

LeCun:一個(gè)智能助手的重要組成部分當(dāng)然是搜索。你搜索事實(shí),并鏈接到這些事實(shí)的來源。這樣,與你交談的人就會信任這個(gè)結(jié)果。所以搜索引擎是完整AI系統(tǒng)的一個(gè)組成部分。

但歸根結(jié)底,目標(biāo)不是直接與谷歌競爭,而是服務(wù)于那些想要AI助手的人。

未來每個(gè)人都會隨時(shí)有一個(gè)AI助手,這將成為一個(gè)新的計(jì)算平臺。以前我們稱之為元宇宙,但這些眼鏡最終會有顯示器,增強(qiáng)現(xiàn)實(shí)顯示器。已經(jīng)有了這方面的演示,比如獵戶座項(xiàng)目。我們現(xiàn)在可以把它做得足夠便宜,可以出售了。

Q:現(xiàn)在人力助手的成本要低得多。目前,Meta預(yù)計(jì)將花費(fèi)380億至400億美元,谷歌表示將超過510億美元,分析師預(yù)測,微軟的支出將接近900億美元。你會擔(dān)心被超越嗎?你認(rèn)為這是一項(xiàng)值得的投資嗎?

LeCun:我不這么認(rèn)為。我沒有在Facebook成立之初就接受這份工作,所以不要問我這個(gè)問題。但這是一個(gè)長期的投資,你需要基礎(chǔ)設(shè)施才能以合理的速度為越來越多的人運(yùn)行這些AI助手。

目前有6億人使用Meta AI,開源引擎Llama已經(jīng)被下載了6.5億次,這是一個(gè)驚人的數(shù)字。在世界各地有85000個(gè)項(xiàng)目衍生自Llama,都是公開可用的,大部分都是開源的。很多這些項(xiàng)目基本上都是在訓(xùn)練Llama說一種特定的語言,比如來自印度的語言。

我不認(rèn)為這筆投入是冤枉的,因?yàn)閷頃泻芏嗳嗣刻焓褂眠@些AI系統(tǒng),在一兩年內(nèi)會有很大增長。而這些系統(tǒng)如果更強(qiáng)大,就會更有用,同時(shí)計(jì)算成本就越高。所以這項(xiàng)投資是基礎(chǔ)設(shè)施的投資。

Llama就像AI界的Linux

Q:Meta最近發(fā)布了Llama3.3,你覺得它的主要作用是什么?和其他公司的封閉模型對比起來有什么特點(diǎn)?

LeCun:Llama和大多數(shù)其他模型的主要區(qū)別在于它是免費(fèi)的和開源的。從技術(shù)上來說,開源軟件就是帶有源代碼的軟件,你可以修改它、自己編譯,你可以免費(fèi)使用。而且,在大多數(shù)許可證下,如果你對它做了一些改進(jìn),并且你想在一個(gè)產(chǎn)品中使用它,你必須以源代碼的形式發(fā)布你的改進(jìn),這樣就使得開源項(xiàng)目能夠非常快速地發(fā)展,多年來這一直是一種成功的軟件分發(fā)方式。

整個(gè)互聯(lián)網(wǎng)都運(yùn)行在開源軟件上,世界上大多數(shù)計(jì)算機(jī)都運(yùn)行在Linux上,除了少數(shù)桌面電腦和一些iPhone之外,其他所有的計(jì)算機(jī)都是這樣。Linux非常成功,原因是它是一個(gè)平臺,人們可以修改它,讓它更安全、更可靠等等,讓它能夠在各種硬件上運(yùn)行。這并不是設(shè)計(jì)出來的,而是市場力量自然推動的。

在AI領(lǐng)域,判斷某物是否為開源變得復(fù)雜,因?yàn)闃?gòu)建AI系統(tǒng)首先要收集訓(xùn)練數(shù)據(jù),其次要在這些訓(xùn)練數(shù)據(jù)上訓(xùn)練所謂的基礎(chǔ)模型。那個(gè)訓(xùn)練代碼和數(shù)據(jù)通常是不公開的。例如,Meta不公開Llama模型的訓(xùn)練數(shù)據(jù)或大部分訓(xùn)練代碼。

然后你可以分發(fā)訓(xùn)練好的基礎(chǔ)模型,比如Llama。它開源了代碼,你可以在任何地方運(yùn)行該系統(tǒng),并且還可以進(jìn)行微調(diào)。你不需要支付費(fèi)用給Meta,也不需要向他們詢問,你可以自己做這些事情。但這有一些限制,主要是由于法律環(huán)境的原因。

大型模型很多都是封閉的,比如OpenAI、Anthropic和Google,這可能是因?yàn)樗麄兿氆@得商業(yè)優(yōu)勢,比如你想直接從這種類型的產(chǎn)品中獲得收入,并且你認(rèn)為自己或者可以領(lǐng)先于技術(shù),那么可能就有理由保持封閉。

但對于Meta來說,Meta的AI工具是一整套體驗(yàn)的一部分,這些體驗(yàn)都是靠廣告收入來資助的,所以AI不是主要的收入來源。另一方面,我們認(rèn)為平臺會發(fā)展得更快,事實(shí)上我們已經(jīng)看到了Llama平臺促進(jìn)了更多的創(chuàng)新。有很多創(chuàng)新是我們沒有想過、或者我們沒有辦法做到,但人們有了Llama模型之后,他們能夠進(jìn)行實(shí)驗(yàn),然后提出新的想法。

Q:有很多人批評說Meta之前在AI競爭里面落后,開源模型是你們用來追趕的工具,你怎么看?

LeCun:首先,你必須意識到,除了谷歌之外,這個(gè)行業(yè)里的每個(gè)人在構(gòu)建人工智能系統(tǒng)時(shí)都在使用一個(gè)名為PyTorch的開源軟件平臺。這個(gè)平臺主要由Meta開發(fā),后來Meta把所有權(quán)轉(zhuǎn)讓給了Linux基金會,所以現(xiàn)在它不再屬于Meta了。OpenAI的所有人都使用它,所以沒有Meta,GPT和Claude等模型或許發(fā)展不到今天的程度。

像GPT這樣的工具,其中使用的底層技術(shù)是在不同地方發(fā)明的。OpenAI在它們不那么保密的時(shí)候做出了一些貢獻(xiàn),它們在過去三年左右的時(shí)間里逐漸變得保守。谷歌當(dāng)然也做了一些貢獻(xiàn),但從未真正開放過。他們試圖秘密地推動這項(xiàng)技術(shù)。

我認(rèn)為Meta是一個(gè)相當(dāng)大的研究機(jī)構(gòu),我們的研究組織叫做FAIR,過去叫Facebook Research,現(xiàn)在主要做基礎(chǔ)研究。我們有大約500人在那里工作。我們正在研究的實(shí)際上是下一代人工智能系統(tǒng),超越了LLMs,超越了大語言模型,超越了聊天機(jī)器人。這就是所謂的大概念模型,這是一個(gè)特定的部分。

更安全的AI系統(tǒng)可以提前設(shè)計(jì)

Q:你說過專有AI模型集中在少數(shù)幾家公司手中是一個(gè)巨大的危險(xiǎn)。開源模型的批評者也擔(dān)心,不良行為者可能會利用它們來傳播錯(cuò)誤信息、網(wǎng)絡(luò)戰(zhàn)、生物恐怖主義等。談?wù)勥@兩者之間的區(qū)別。Meta在防止這些情況發(fā)生的方面有什么作為?

LeCun:這是一個(gè)巨大的爭論。我們第一次發(fā)布Llama是相當(dāng)近期的事情,第一個(gè)Llama不是開源的。你必須請求許可,你必須證明你是一名研究人員。這是因?yàn)榉森h(huán)境不確定,我們不知道人們會用它做什么。

所以我們進(jìn)行了幾個(gè)月的內(nèi)部討論,每周兩個(gè)小時(shí),有40個(gè)人參與。關(guān)于安全性、法律環(huán)境等各種問題進(jìn)行了非常嚴(yán)肅的討論。然后在某個(gè)時(shí)候,馬克決定開放Llama 2的源代碼。這是在2023年夏天完成的。從那時(shí)起,它基本上完全推動了整個(gè)行業(yè)。

為什么它比這些公司控制的專有模型更安全?因?yàn)?strong>有更多的人在關(guān)注它,所以有更多的人在為各種事情微調(diào)它。

有一個(gè)問題是,可能有很多人懷著惡意使用它。所以在Llama團(tuán)隊(duì)中,曾經(jīng)對所有我們發(fā)布的系統(tǒng)進(jìn)行Red Team測試,確保它們至少在發(fā)布時(shí)基本上是安全的。

我們甚至最初將Llama 2給了一群黑客,在Defcon上讓他們嘗試做壞事,比如嘗試入侵系統(tǒng)之類的,這被稱為白帽。結(jié)果是,在過去的將近兩年里,我們還沒有意識到任何真正糟糕的事情發(fā)生在我們分發(fā)的任何模型上。

Q:如果你的愿景是AI成為所有人類知識的寶庫,那么所有的人類知識都必須可用于訓(xùn)練這些模型。而其中大部分要么沒有數(shù)字化,要么數(shù)字化了但沒有公開。

LeCun:比如法國國家圖書館的全部內(nèi)容都數(shù)字化了,但不可用于訓(xùn)練。我并不是在談?wù)摪鏅?quán)作品。我的家族來自布列塔尼,法國西部。那里的傳統(tǒng)語言已經(jīng)瀕臨消失,現(xiàn)在只有大約3萬人每天說這種語言。

如果你想讓未來的LLM說布列塔尼語,就需要有足夠的訓(xùn)練數(shù)據(jù)。你將從哪里得到這些數(shù)據(jù)?你會得到文化非營利組織的幫助,他們收集他們擁有的所有東西。也許政府會幫助他們。但他們可能會說,我想讓你們的系統(tǒng)說布列塔尼語,但我不想就這么把我的數(shù)據(jù)給你。

我認(rèn)為最好的方法是訓(xùn)練一個(gè)AI系統(tǒng),一個(gè)分布式的全球AI系統(tǒng)倉庫,使用各地的數(shù)據(jù)為全球系統(tǒng)做出貢獻(xiàn)。你不需要復(fù)制數(shù)據(jù)。

對于Linux來說,實(shí)際上它主要是由那些公司員工支持的,這些公司告訴他們實(shí)際上要分發(fā)他們的貢獻(xiàn)。你可以有一個(gè)類似的系統(tǒng),每個(gè)人都可以為這個(gè)全球模型做出貢獻(xiàn),這是每個(gè)人的AI。

Linux你是不用付費(fèi)的,但如果你買了一個(gè)運(yùn)行Linux的小部件,比如安卓手機(jī)或者車?yán)锏挠|摸屏,你為購買的小部件付費(fèi)。AI也是如此,基礎(chǔ)模型將會是開源且免費(fèi)的。

現(xiàn)在,它確實(shí)感覺像是少量的力量在操控著一切。這個(gè)愿景很美好,但目前并沒有很好地實(shí)現(xiàn)。不過,在我看來,這是不可避免的。

Q:談到辯論,你喜歡與其他AI教父進(jìn)行公開辯論,比如你的獲獎(jiǎng)同行Jeffrey Hinton和Yoshua Bengio。他們都對AI的潛在危險(xiǎn)發(fā)出了警告。

LeCun:我不認(rèn)為需要對研發(fā)進(jìn)行監(jiān)管。我在加州法案SB 1047上與他們產(chǎn)生了分歧。Hinton和Bengio都支持這個(gè)法案,而我則反對。我認(rèn)為監(jiān)管研發(fā)會給AI系統(tǒng)帶來災(zāi)難性的后果。我說,存在風(fēng)險(xiǎn)是一種幻覺,是一小撮偏執(zhí)的智庫所推動的。

但Hinton和Bengio并不偏執(zhí)。Hinton剛剛因?yàn)樗墓ぷ鳙@得了諾貝爾獎(jiǎng)。另外,加州州長否決了這個(gè)法案,但他正在與斯坦福大學(xué)的教授合作對其進(jìn)行修訂。

我之所以稱其為胡說八道,是因?yàn)槲艺J(rèn)為這些危險(xiǎn)已經(jīng)被夸大了,以至于變得扭曲。一些人說AI會在五個(gè)月內(nèi)殺死我們所有人,這顯然是錯(cuò)誤的。

Q:讓我們來談?wù)凙GI(通用人工智能),以及我們距離它還有多遠(yuǎn)。當(dāng)人們聽到這個(gè)時(shí),他們會想到《終結(jié)者》或《我,機(jī)器人》之類的情節(jié)。

LeCun:Hinton和Bengio認(rèn)為AGI的時(shí)間表可能是五年,而我認(rèn)為可能需要十年甚至更長。

我不知道會是什么時(shí)候,但我個(gè)人認(rèn)為最早可能在五到六年后,但可能更接近十年。因?yàn)檫@比我們想象的要難得多,歷史上人們總是低估AI的發(fā)展難度。

我們現(xiàn)在還沒有達(dá)到人類水平的智能,甚至不知道如何用AI系統(tǒng)做很多事情,比如制造家用機(jī)器人或五級自動駕駛汽車。在我們找到新的方法之前,我們甚至還沒有走上實(shí)現(xiàn)人類水平智能的道路。

一旦我們有了一個(gè)藍(lán)圖和一些可信的演示,證明我們可能有一條通往人類水平智能的道路,我們就會知道如何使其安全。這就像在20世紀(jì)20年代,有人告訴你幾十年后我們將能夠以接近音速的速度飛行數(shù)百萬英里橫跨大西洋,你會說:“天哪,你怎么知道這安全?”但渦輪噴氣機(jī)最終被證明是非常可靠的。

所以,讓AI安全意味著以安全的方式設(shè)計(jì)AI系統(tǒng)。但在我們設(shè)計(jì)出來之前,我們無法使其安全。

Q:你似乎不擔(dān)心AI會想要統(tǒng)治人類。你說當(dāng)前的AI比家貓還笨。無論AI是否真的想要統(tǒng)治我們,我們是否應(yīng)該對AI和AI研發(fā)施加一些限制?

LeCun:我認(rèn)為,對于研發(fā)來說,不需要任何限制。但如果你想推出一個(gè)家用機(jī)器人,你可能會希望硬編碼一些規(guī)則,在系統(tǒng)構(gòu)建時(shí)嵌入遵循法律,比如當(dāng)有人在場時(shí),機(jī)器人不能拿著刀亂揮。

當(dāng)前AI系統(tǒng)的設(shè)計(jì)在某種程度上是固有不安全的。你需要訓(xùn)練它們按照你的意愿行事。我提出了一種稱為目標(biāo)驅(qū)動的另一種架構(gòu),AI系統(tǒng)基本上只是為了實(shí)現(xiàn)一個(gè)目標(biāo)而存在,不能做任何其他事情,只能在這個(gè)目標(biāo)的約束下行動。

Q:現(xiàn)在很多人,包括Hinton和Benjo在內(nèi),都支持一封由OpenAI現(xiàn)任和前任員工簽名的信,呼吁AI公司的員工有權(quán)警告技術(shù)的嚴(yán)重風(fēng)險(xiǎn),你沒有支持那封信。你是怎么看待模型安全這個(gè)問題的呢?

LeCun:我不是這個(gè)意思。比如像禁止在公共場所使用大規(guī)模人臉識別這樣的措施是件好事 。

還有一些措施,比如未經(jīng)允許就改變某人在視頻中的面部,這基本上已經(jīng)是合法的,我們擁有這些工具并不意味著它們就不違法。可能需要針對這些行為制定定特定的規(guī)則,但我對此沒有意見。

我對AI本質(zhì)上危險(xiǎn)以及需要監(jiān)管研發(fā)的觀點(diǎn)有異議,我認(rèn)為這是適得其反的。在未來,我們將擁有那些我認(rèn)為對未來民主至關(guān)重要的開源平臺,那些規(guī)則將會適得其反,它們會讓開源變得太冒險(xiǎn),以至于任何公司都不敢分發(fā),這樣這些私人公司將控制一切。

如果一切都來自美國西海岸的三家公司,我們都說著同樣的語言,有著同樣的文化,這完全不可接受。

他們想要的是開放的平臺,然后可以針對任何文化、價(jià)值體系或興趣中心進(jìn)行微調(diào),這樣全世界的用戶都有選擇,他們不必使用三個(gè)助手,他們可以使用其他的。

我們在印度與幾個(gè)組織合作,下一個(gè)版本的Llama能夠說印度所有的22或29種官方語言,這甚至還不足以涵蓋印度的所有語言,因?yàn)橛《扔?00種語言,其中大部分是口語,沒有書面語。現(xiàn)在我們有技術(shù)可以讓聊天機(jī)器人實(shí)際上處理純粹的口語,這是令人驚嘆的。

我們在越南也做了類似的努力,我們看到全世界的人們都在調(diào)整這些模型,并將其用于各種用途。我認(rèn)為我們需要一種更自覺的全球合作伙伴關(guān)系,這些系統(tǒng)從一開始就作為基礎(chǔ)模型,能夠說世界上所有的語言并理解所有的文化,這樣的話,這些努力就會更容易成功,我們可以為各種應(yīng)用構(gòu)建專門的系統(tǒng)。

參考鏈接:

[1]https://www.youtube.com/watch?v=UmxlgLEscBs

- 打臉!GPT-4o輸出長度8k都勉強(qiáng),陳丹琦團(tuán)隊(duì)新基準(zhǔn)測試:所有模型輸出都低于標(biāo)稱長度2025-01-15

- 好家伙,海螺直接拍了個(gè)AI版的《教父》2025-01-10

- 2025-01-08

- 用大模型吃瓜更智能了!阿里通義實(shí)驗(yàn)室提出新時(shí)間線總結(jié)框架2025-01-07