三次元風景照秒變宮崎駿動畫,還能把石原里美吉卜力化,AnimeGAN已開源

魚羊 發自 凹非寺

量子位 報道 | 公眾號 QbitAI

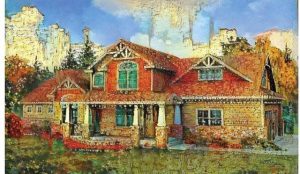

看到這樣的街角,是不是想問這是哪一部日本動畫電影里的場景?

宮崎駿、新海誠的電影常常從現實場景中獲取靈感,這張“日本動漫”截圖同樣有對應的真實空間。

但這一次,打破次元壁的卻不是人類畫師,而是一只名叫AnimeGAN的GAN。

繁華街道,車水馬龍,幾秒即可在二次元場景中復現:

即便是西方街景,在AnimeGAN的畫筆下,也能毫無違和轉化成日漫畫風:

看完AnimeGAN的作品展示,我產生了一個大膽的想法。

看,我的二次元和三次元老婆完美統一了!

風格遷移+生成對抗網絡(GAN)

這項來自武漢大學和湖北工業大學的研究,采用的是神經風格遷移 + 生成對抗網絡(GAN)的組合。

除了解決生成圖像動畫風格紋理不明顯、丟失原始圖像內容這樣的問題,AnimeGAN最大的特點是快。

比如上面的石原里美,在V100上跑了1.64s就完成了次元的躍遷。

那么,這個輕量級的GAN有什么樣的特別之處呢?

AnimeGAN架構

作者介紹,AnimeGAN是基于CartoonGAN的改進,并提出了一個更加輕量級的生成器架構。

AnimeGAN的生成器可以視作一個對稱的編碼器-解碼器網絡,由標準卷積、深度可分離卷積、反向殘差塊、上采樣和下采樣模塊組成。

為了有效減少生成器的參數數量,AnimeGAN的網絡中使用了8個連續且相同的IRB(inverted residual blocks)。

在生成器中,具有1×1卷積核的最后一個卷積層不使用歸一化層,跟隨其后的是tanh非線性激活函數。

上圖中,K為內核大小,C為特征圖數量,S為每個卷積層的跨度,H是特征圖的高度,W是特征圖的寬度,Resize值用于設置特征圖大小的插值方法,⊕表示逐元素加法。

損失函數

論文還提出了三個新的損失函數,以提升風格化的動漫視覺效果。

△不同權重的定性比較

灰度風格損失:

灰度對抗損失:

生成器網絡的顏色重建損失(基于圖像像元的損失):

實驗結果

與CartoonGAN相比,可以明顯看出AnimeGAN參數更少,模型更小,計算量更少,推理速度更快,是一個相對輕量級的GAN。

細節甚至還更勝一籌。

與此前的SOTA方法相比,可以看出,CartoonGAN生成的動漫圖像中通常會存在顏色偽影區域(圖中紅框),ComixGAN生成的動漫圖像中通常會存在過度風格化的區域(失去了原始照片的內容,目標紋理難以辨識),而AnimeGAN很好地解決了這些問題。

定性分析,AnimeGAN取得了比SOTA方法更高質量的視覺動漫效果。

目前,AnimeGAN已經開源,數據集和預訓練模型均可下載。如果你也想把自己記錄的風景用宮崎駿/新海誠/今敏的風格呈現,不妨一試~

One More Thing

或許你已經猜出來了,AnimeGAN的作者們本身也是二次元文化愛好者,出于興趣開始了這樣一個研究項目,真·「我的興趣就是我的工作」。

論文作者,是湖北工業大學劉罡副教授,陳頡博士和他們的學生Xin Chen。

此前,劉教授和Xin Chen還研究了一個動漫線稿自動上色模型,GitHub用戶@pradeeplam根據他們的論文進行了復現,效果也很不錯。

傳送門

GitHub地址(含論文):https://github.com/TachibanaYoshino/AnimeGAN

作者知乎專欄:https://zhuanlan.zhihu.com/p/76574388

上色項目:https://github.com/pradeeplam/Anime-Sketch-Coloring-with-Swish-Gated-Residual-UNet

— 完 —

- 蘋果芯片主管也要跑路!庫克被曝出現健康問題2025-12-07

- 世界模型和具身大腦最新突破:90%生成數據,VLA性能暴漲300%|開源2025-12-02

- 谷歌新架構突破Transformer超長上下文瓶頸!Hinton靈魂拷問:后悔Open嗎?2025-12-05

- 90后華人副教授突破30年數學猜想!結論與生成式AI直接相關2025-11-26