狙擊Gemini 3!OpenAI發布GPT-5.1-Codex-Max

奧特曼:夸完你的夸我的

聞樂 發自 凹非寺

量子位 | 公眾號 QbitAI

Gemini 3力壓全場,OpenAI坐不住了。

發布Codex新版本——GPT-5.1-Codex-Max,突破上下文窗口限制,實現跨越數百萬token的長時間連續工作,最長超過24小時的那種。

新模型任務效率也更高。它做的太陽系引力沙盒和上一代GPT-5.1-Codex的對比是這樣的(多加了幾個“太陽”看引力效果):

△上:GPT-5.1-Codex-Max 下:GPT-5.1-Codex

資源消耗是這樣的:

于是,奧特曼昨天剛夸完Gemini 3,今天又趕來給自家GPT-5.1-Codex-Max站臺,咱說這也太忙了(doge)。

新版本在METR達到新SOTA。這個指標衡量的是,用人類做任務的時間當參照,看AI有一半概率能搞定同款任務的能力。

其實就是先看人類做某類軟件工程任務得花X小時,然后看AI模型能不能有50%的概率,把這項任務給完成了。

上面數據說明,在這種情況下,GPT-5-Codex-Max有50%的概率能夠成功完成一項原本需要人類2小時42分鐘完成的軟件工程任務。

這比GPT-5對標的時間還多了25分鐘。

超長待機

AI編程現在這么火,各家也都在奮力加碼自家模型。

在這個前沿賽道,模型處理復雜任務的推理能力、持久力與穩定性,始終是衡量效能的關鍵指標。

而GPT-5.1-Codex-Max這次也是做了大升級。

首先,它在PR創建、代碼審查等實際軟件工程任務中訓練,推理變得更快更有效。也是OpenAI首個能在Windows環境中的模型。

在SWE-bench Verified測試中,同樣medium推理力度下,它比之前的GPT?5.1-Codex性能更好,且思考token使用減少了30%。

而且針對非延遲敏感任務還推出了xhigh推理力度選項,思考時間更長答案更好。

說到思考時間長,這次的新版本對于長時間運行任務的處理也比較出色,能夠實現“超長待機”,跨多個上下文窗口連貫工作。

這是因為GPT-5.1-Codex-Max原生支持壓縮,突破了上下文窗口限制。

具體來說,在接近上下文窗口限制時,模型會自動壓縮對話,獲得新上下文窗口然后繼續任務,直到完成。

在內部評估中,它能一次獨立運行超過24小時,連貫處理數百萬個token。

看樣子,新模型在處理長運行、高強度的任務上比較有優勢。

比如,它在應對書籍、長文檔分析等超長篇幅任務時,就無需拆分內容,避免信息割裂產生的理解偏差。

也能支撐高負載、長周期的持續工作。

OpenAI研究員Noam Brown對此表示:(雖然現在表現就很不錯但)尚未遇到瓶頸,還沒達到極限。

目前,GPT-5.1-Codex-Max已在Codex中支持與CLI、IDE擴展、云端和代碼審查工具結合使用,API接口很快也會上線。

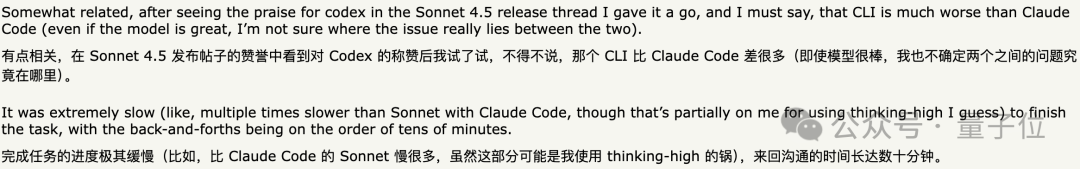

當然了,新的編程模型一出,Claude是肯定會被拉出來遛一下的。

相比之下,Claude Code速度更快。

新版Codex的token消耗量更友好。

或許,Claude和Codex的組合拳更能打。

OMT

一天時間,Gemini 3、Grok 4.1 Fast、GPT-5.1-Codex-Max都來了,好一個硅谷345組團上新(doge)。

這位網友你真相了說得有道理。

實際上,OpenAI這次還悄悄發布了GPT-5.1 Pro。

雖然官方介紹僅有寥寥幾筆,但通過第三方測評來看,這個Pro版本看上去還是有點東西的。

尤其是在指令遵循方面做得更好。

雖然在一定程度上和Gemini 3有差距,但如果能接入IDE,將發揮出更大的潛力。

參考鏈接:

[1]https://x.com/polynoamial

[2]https://openai.com/index/gpt-5-1-codex-max/

[3]https://x.com/sama/status/1991258606168338444

[4]https://x.com/OpenAI/status/1991266192905179613

[5]https://news.ycombinator.com/item?id=45982649

[6]https://x.com/mattshumer_/status/1991263717820948651

— 完 —

- 萬卡集群要上天?中國硬核企業打造太空超算!2025-11-29

- 學生3年投稿6次被拒,于是吳恩達親手搓了個評審Agent2025-11-25

- 波士頓動力前CTO加盟DeepMind,Gemini要做機器人界的安卓2025-11-25

- 青年科學家數量創新高!35位新一期“新基石研究員”獲資助2025-11-24