拿下3D生成行業新標桿!昆侖萬維Matrix-3D新模型鯊瘋了,一張圖建模游戲場景

單圖秒變360°全景,還能直接還原可漫游的3D世界

3D生成的行業新標桿,這一次由國產玩家樹立。

萬萬沒想到,這樣一個堪比游戲全景視角的場景,竟然只由一張圖片生成?!

在360°自由環視下,由亭子一隅延伸出的畫面始終保持內容一致:

面對更考驗幾何、色彩能力的場景,也能生成比較真實自然的3D世界。

仔細看,畫面所呈現的幾何關系(如位置、大小、形狀)和遮擋關系基本挑不出毛病,不同區域的顏色也沒有突兀的地方。

更神奇的是,我們還能隨心所欲控制運動軌跡。

比如先讓圖片來個直行:

然后立馬再來個蛇形走位,拐一個S彎:

甚至,對比李飛飛World Labs團隊所采用的方法,新模型還支持更大范圍的移動。

原圖是醬嬸兒的:

李飛飛World Labs團隊讓這張圖的視角逐漸推進,最終生成結果如下:

而Matrix-3D新模型生成的場景明顯更為豐富,全景視角下空間感也更為強烈。

不賣關子了,Matrix-3D正是國產玩家昆侖萬維最新推出的3D世界生成框架。

作為一個融合全景視頻生成與3D重建的統一框架,它從單圖像出發,能夠生成高質量、軌跡一致的全景視頻,并直接還原可漫游的3D空間。

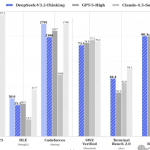

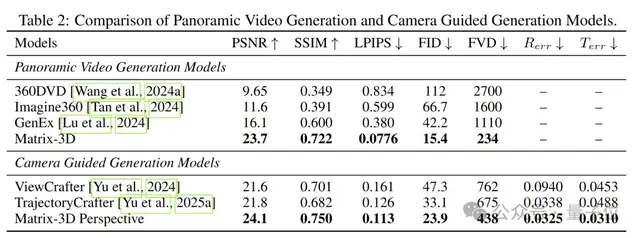

官方測評顯示,Matrix-3D在多個主流評估指標上優于360DVD、Imagine360和GenEx,取得全景視頻生成任務的SOTA成績。同時,在相機軌跡引導下的生成任務中,Matrix-3D也在視覺質量和相機可控性方面超越現有方法。

那么,Matrix-3D是如何從一眾競爭對手中脫穎而出的呢?

樹立3D世界生成新標桿

事實上,Matrix-3D并非昆侖萬維第一次在世界模型領域大秀肌肉~

早在今年2月,這家公司就推出全新自研的世界模型——Matrix系列,成為中國第一家同時推出3D場景生成、可交互視頻生成模型的探索空間智能的企業。

今年5月13日,昆侖萬維也正式開源了(17B+)Matrix-Game大模型,即Matrix-Zero世界模型中的可交互視頻生成大模型。Matrix-Game是Matrix系列在交互式世界生成方向的正式落地,也是工業界首個開源的10B+空間智能大模型,它是一個面向游戲世界建模的交互式世界基礎模型,專為開放式環境中的高質量生成與精確控制而設計。

如今幾個月過去,Matrix-3D算是昆侖萬維在確立領先優勢后持續投入、不斷優化的階段性成果。

并且這一次,從效果和技術突破兩方面來看,Matrix-3D的優勢還在擴大。

從比較直觀的生成效果來看,Matrix-3D目前具備以下核心優勢:

- 場景全局一致:支持360°自由視角瀏覽,幾何結構準確、遮擋關系自然,紋理風格統一。

- 生成場景范圍大:與現有場景生成方法相比,支持更大范圍的、可360°自由探索的場景生成。

- 生成高度可控:同時支持文本和圖像輸入,結果與輸入高度匹配,支持自定義范圍與無限擴展。

- 泛化能力強:基于自研3D數據與視頻模型先驗,可生成豐富多樣的高質量場景。

- 生成速度快:首個Feed-Forward(前饋神經網絡)全景3D場景生成模型,生成速度更快。

話不多說,直接來看更多玩法~

首先,Matrix-3D最極簡的玩法是,開局只給它一張參考圖(然后還你整片森林bushi。

咔咔一頓輸出后,不僅能看到鏡頭環繞石堆的全景效果(補全了河流、白云等周圍環境),而且連每一塊石頭的物理光影也能隨之正確變換。

給圖片加上提示詞,沉浸式體驗游戲的feel立馬出來了。

一個方塊像素化的景觀,包含山脈、樹木、水體、天空、云朵,類似《我的世界》風格,高分辨率,色彩鮮艷,紋理細節豐富,氛圍寧靜。

雖然只提供了某一幀畫面,但它也能輕松還原整個場景,形成了一個可供玩家自由探索的游戲世界。

是不是很有《我的世界》內味兒了~

與此同時,正如開頭提到的,Matrix-3D還支持玩家自由控制運動軌跡。

僅“看一眼”某個山坡的局部圖,再結合用戶提供的軌跡圖,就能從各種方位開啟第一視角爬山之旅。

而且不止S彎和直行,切換成其他軌跡也是OK的。(比如右前方前進)

值得一提的是,Matrix-3D還支持將全景視頻轉化為3D世界。

如此一來,我們就能直接對圖片展開自由探索:

最后更關鍵的是,Matrix-3D還支持無限續寫。

就是說,當用戶生成一段場景后,還可以在此基礎上對場景進行擴寫。

跳過參考圖和提示詞,第一段be like:

基于第一段,鏡頭繼續來到旁邊的另一座研究基地。

可以看到,整個基地的面貌更完整了,而且沒有丟失第一段中的關鍵素材(如第一座基地中分散在各角落的人)。

如此“俄羅斯套娃”后,最終用戶將得到一個貼近提示詞的科幻大片場景:

一座建在冰川上的未來研究基地,配有發光穹頂和先進機械,四周環繞著冰封景觀,具有科幻美學風格,畫面極為細致精美。

順帶一提,Matrix-3D提供兩種場景重建方案——基于前饋神經網絡的方案10s即可完成場景重建,而基于3DGS優化的方案可重建出更精細逼真的場景。

小結一下,Matrix-3D能樹立行業新標桿,正是因為它在生成質量上實現了多項關鍵進步。

而且不止模型能力變強,從技術方面看,背后還蘊藏著團隊對多項行業技術難題的成功突破。

包括但不限于下面這些:

- 相比基于透視圖訓練的主流思路,全景圖可以突破視覺范圍限制;

- 相比主流的點云渲染策略,網格渲染能有效提升幾何一致性和色彩一致性;

- 基于前饋式網絡的3DGS優化策略,能加速3D生成;

- 利用合成數據,3D場景數據稀缺的問題能夠得到解決;

- ……

憑借產品+技術的雙重優勢,Matrix-3D再次刷新3D世界生成的行業標桿。

下面我們繼續深入扒一扒Matrix-3D背后的技術細節。

背后技術細節

整體而言,Matrix-3D主要通過引入全景表示、條件視頻生成與3D重建模塊,突破了現有方法在視角范圍、幾何一致性和視覺質量上的限制。

其核心模塊及大致作用如下:

1、軌跡引導的全景視頻生成模塊:根據用戶輸入的圖片/文字,生成符合給定相機軌跡的全景視頻。

2、雙路徑可選擇的全景3D重建模塊:提供分別主打精細和生成速度的兩種方案,來將全景視頻變成一個可自由探索的3D場景。

3、Matrix-Pano數據集:一個大規模高質量合成數據集,包含116K條帶有相機軌跡、深度圖和文本注釋的靜態全景視頻序列。

對于上述組件,接下來我們按照以下思路進行詳細拆解:

1)為什么要這樣設計?

2)怎樣實現這個設計?

3)如何訓練這個模型?

為什么選用全景圖而非透視圖?

一上來,團隊就從全局考慮了3D場景生成的泛化性問題。

受限于3D場景數據的稀缺性,目前的主流思路是利用圖像或視頻生成模型作為先驗來實現強泛化。

簡單說,前者通過捕捉2D圖像中的紋理或細節等特征來輔助構建3D世界,后者則通過學習相機環視時的視角變化(由視頻模型生成),來模擬空間結構和生成3D場景。

然而這類方法都是在透視圖上進行訓練,僅能覆蓋小范圍的場景,一旦用戶超出該范圍查看場景時,就會有明顯的場景邊界,影響用戶的沉浸體驗以及VR/AR等下游應用。(下圖左半部分)

因此,為了保證生成的場景支持任意地點、任意角度查看,團隊選用了全景數據作為場景生成的中間表達。

一般而言,全景圖可以覆蓋360°的水平視角和180°的垂直視角,支持用戶在任意角度查看。一旦將多個位置的全景圖拼接在一起構成全景視頻,就能包含3D世界生成所需的所有信息。(上圖右半部分)

三個核心模塊實現單圖/文本→3D世界生成

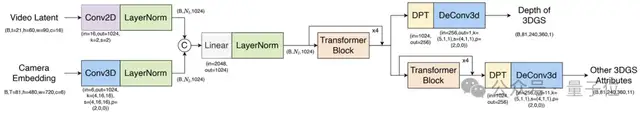

借助全景視頻中間表達,Matrix-3D具體則通過三個核心模塊實現從單圖/文本到3D世界的生成:

- 全景圖生成模塊:從用戶輸入的文本或透視圖生成全景圖;

- 可控全景視頻生成模塊:根據用戶指定的探索軌跡和范圍精準生成全景圖視頻;

- 3D場景生成模塊:從全景圖視頻中解碼出3D場景,支持用戶自由探索。

訓練階段的優化設計

訓練開始前,團隊將重點放在為視頻擴散模型提供更精準的參考條件上。

其中,全景圖的生成通過LoRA微調生圖模型實現。

為了生成可控的全景視頻,團隊基于首幀的全景圖和深度信息搭建了一個初始的3D網格,然后沿著用戶設定的路徑對這個網格進行渲染,作為后續視頻生成的參考。

相較于當前主流的點云渲染策略,通過網格渲染得到的信號能包含準確的前后景遮擋關系,且不會出現噪聲條紋。

因此有效提升了生成結果的幾何一致性和色彩一致性。

然后就是根據這些精準的條件信號進行訓練。

在訓練視頻生成模型時,團隊首先對場景網格渲染結果進行編碼,并將其對應的Mask(遮罩圖)下采樣,再將這兩者和噪聲隱向量在通道維度(channel dimension)拼接,一起作為模型的輸入。

團隊稱這一設計簡單有效,保證了生成結果與輸入條件信號高度相符,提升了模型的控制精度。

同時,團隊在模型的DiT模塊中引入了Cross Attention機制,用于融合殘缺視頻序列和完整視頻序列對應的隱向量。

這一設計進一步增強了模型輸出與輸入條件的匹配度,提高了全景視頻生成的精度和泛化能力。

此外,為了加速訓練過程,團隊在視頻基模上進行LoRA微調,而非全量參數訓練。

當視頻生成完成后,最終還需要將其轉化為可交互的3D場景。對此,團隊設計了兩種不同的重建方式:

- 基于深度估計+透視圖3DGS優化,可以生成精細的高質量場景;

- 基于前饋式網絡(Feed-Forward Network)的3DGS優化,主打快速生成。

后者用Transformer網絡直接從視頻隱空間預測全景3DGS的各個屬性,且為了加速網絡收斂,提出了先訓練深度、再訓練其他參數的分步訓練策略。

Matrix-Pano數據集

當然,以上訓練也離不開一個高質量的數據集——Matrix-Pano。

現有的3D場景數據集通常存在質量和成本方面的問題。不僅普遍規模較小、質量參差不齊,且缺乏精確的相機和幾何標注;同時,真實世界3D場景數據的采集成本也非常高昂。

而Matrix-Pano則完全基于Unreal Engine(虛擬引擎)構建,具備高仿真的物理和視覺效果,包含116K全景視頻,共22M全景幀,涵蓋室內室外504個高質量3D場景及多樣的天氣與光照條件。

此外,所有視頻均配有精確的相機與軌跡標注。

為了支撐如此大規模、高質量的視頻數據采集,團隊還專門設計了一整套自動化軌跡生成與采集系統。

概括而言,這套系統主要通過三步實現高質量的視頻采集:

- 軌跡生成:提出了一種高效的軌跡采樣算法以生成合理且視覺連貫的相機路徑,最終僅保留長度超過18米的軌跡,以保證視頻序列的動態性。

- 高仿真精確碰撞檢測:采用邊界框代理進行路徑仿真,實時剔除發生幾何剪切或物體穿透的軌跡,保證全景視頻運動過程的物理合理性。

- 工業級相機控制:結合控制理論對相機的位置和角度進行平滑處理,保證生成的視頻具有工業級的物理平滑效果。

通過上述多步驟的數據生成與篩選流程,團隊最終保留了116k個高質量全景靜態視頻序列,每個序列均附帶對應的3D探索路徑。

昆侖萬維:瞄準空間智能

以上不難看出,昆侖萬維確實在3D世界生成領域投入了大量心血。

而這一切背后,實則蘊藏著他們對“空間智能”這一前沿技術領域的更大野心。

何謂空間智能?簡單來說,就是讓機器突破傳統二維視覺的限制,能夠像人類一樣感知、理解并作用于三維空間。

根據量子位智庫發布的報告,目前它實際上分為兩個層面:物理的三維世界和數字的三維世界。

在數字世界里,空間智能的代表應用即為3D場景生成,以李飛飛World Labs、騰訊HunyunWorld-1.0為代表(當然也包括Matrix-3D),這些應用通過生成高質量的3D內容,為VR虛擬現實、游戲開發和影視制作等領域提供強大的技術支持。

而在物理世界,空間智能的應用主要體現在自動駕駛、具身智能領域。這些場景在強調感知與理解的同時,更加注重“行動”能力,對交互性的要求也更高。

例如,自動駕駛汽車需要實時感知周圍環境并做出決策,具身智能機器人需要在復雜環境中進行物理交互。

而最終,其目標是構建世界模型,即通過數字化的方式模擬和預測物理世界的運行規律,實現完美“人機交互”。

總而言之,對各行各業來說,空間智能普遍被視為“實現AGI的關鍵一步”,屬于那種“有條件要上,沒有條件創造條件也要上”的核心技術。

具體到昆侖萬維,實際上Matrix-3D的出現并非偶然,而是其長期戰略布局與技術積淀的自然成果。

昆侖萬維Matrix系列世界模型正是其在AGI路徑上的關鍵動作,包括5月正式開源的「可交互視頻生成Matrix-Game大模型」,以及今天同樣開源的「Matrix-3D大模型」——通過3D世界的自動生成,賦能AI對空間的識別與理解能力,這代表著其在“空間智能”方向上的重要探索。

這也符合昆侖萬維一直以來的“All in AGI與AIGC”戰略規劃。

過去三年,他們在視覺多模態、深度學習、強化學習等核心技術領域持續投入,先后推出了多項重磅產品與平臺。

包括天工超級智能體(Skywork Super Agents)、AI音樂創作平臺Mureka、AI短劇平臺SkyReels、AI社交產品Linky等,形成了“AI前沿基礎研究——基座模型——AI矩陣產品/應用”的全棧式AI產業鏈。

其中,空間智能作為多模態發展的延伸方向,已成為不可或缺的一環。

Matrix-3D的出現,正是這一戰略體系向“空間理解”能力進一步延伸的體現。它不僅整合了公司在多模態模型方面的技術積累,也進一步提升了昆侖萬維在世界模型與空間智能賽道上的競爭優勢。

當然,理念落到實處也離不開切切實實的人力、物力支持。

自2023年宣布“All in AGI和AIGC”以來,昆侖萬維在AI研發上投入了大量資金和技術人員。

公開財報顯示,2024年公司的研發費用飆升至15.4億元,同比增幅達59.5%,占總營收比重的27%以上;進入2025年第一季度,這一增長趨勢仍在延續,研發費用達到4.3億元,同比增長23.4%,約占營收的26%。

光投錢還不夠,去年其研發團隊達到1554人,占總人數的73.41%,在國內AI企業中躋身前列。

所以說,Matrix-3D能夠取得這一階段的技術領先,實屬“水到渠成”。

Anyway,盡管空間智能仍處于發展的早期階段,但不可否認,擁有資金、技術與人才三重優勢的昆侖萬維,或許早已在這條通往未來的賽道上占據了先發位置。

1.GitHub:https://github.com/SkyworkAI/Matrix-3D

2.HuggingFace:https://huggingface.co/Skywork/Matrix-3D

3.Technical report:https://github.com/SkyworkAI/Matrix-3D/blob/main/asset/report.pdf

4.Homepage:https://matrix-3d.github.io/

- 英偉達巧用8B模型秒掉GPT-5,開源了2025-12-06

- SpaceX估值8000億美元超OpenAI,IPO就在明年2025-12-06

- 騰訊發布EdgeOne Pages正式版:國內首個邊緣全棧開發平臺,內測階段用戶突破15萬2025-12-05

- 中國AI計算開放架構創新風向標:HAIC2025重磅啟幕2025-12-04