誰是大模型架構新王者? |量子位智庫

分析師 王昕祎

量子位智庫 | 公眾號 AI123All

在大模型研發的最核心架構層,一場全新的競速正在低調展開。

大模型因Transformer架構而走向潮頭,但現在隨著落地進程深入,暴露不出諸多不足,比如推理成本,又比如算力瓶頸。

為解決這些問題,Transformer自身在持續進化,FFN層、Attention機制改進成為近年研究熱點。

與此同時,非Transformer架構頻頻登上行業頭條,“后Transformer時代”的創新,已經在展開。

Transformer架構改進與非Transformer架構突圍,正共同構成大模型架構創新的“雙軌競速”。

我們將從演進路徑、核心創新以及行業實踐等方面梳理這一輪架構革新的關鍵趨勢。

并從與多位行業一線專家的交流調研中提煉架構創新核心Insight。

我們也相信,最核心的創新,往往擁有改寫游戲規則的潛力。

而在后Transformer時代,新范式、新弄潮兒,最后可能就出自這些架構創新活躍玩家中間。

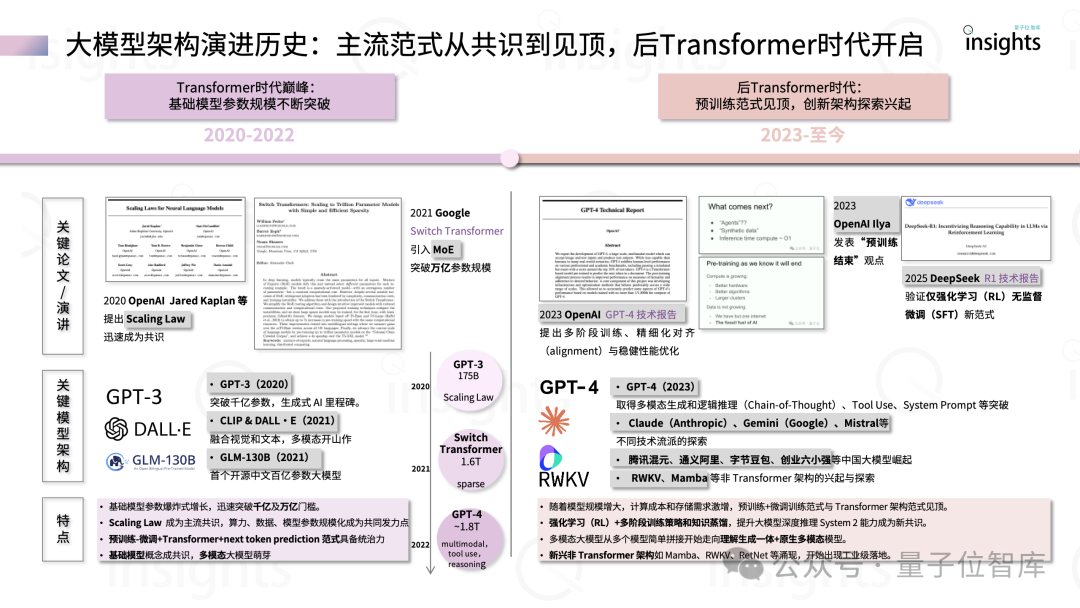

2006年以來,我們可以將大模型架構演進歷史分為4個階段:

前兩個是前Transformer十年、Transformer時代開啟,在這兩個階段,深度學習被引入NLP,Transformer架構被首次提出并迅速成為主流范式。

后兩個階段是:Transformer時代巔峰、后Transformer時代。在這兩個階段,Transformer架構乘著Scaling Law的東風走向巔峰,又迅速見頂、引發諸多質疑與討論,開啟了后Transformer時代的探索。

近年來行業內針對Transformer架構的諸多爭議與弊端,主要從訓練范式革新、架構創新以及工程優化三個方向解決。

本報告主要探討架構創新解決方式,這一方式主要分為Transformer改進與非Transformer探索。

首先在Transformer改進這一方向上,主要的創新集中在Attention機制改進和FFN層改進。

Attention機制是Transformer的靈魂所在,同時也是Transformer被詬病的問題根源,因此對Attention機制的改進是Transformer改進的重中之重,也是近年來絕對的研究熱點。

Attention改進目前主要分為兩大技術方向——稀疏Attention和線性Attention。

具體的Transformer架構改進趨勢點擊文末的報告鏈接獲取閱讀。

近年來主流的非Transformer架構主要致力于在提供同等性能的同時控制算力開銷,計算復雜度基本都為線性復雜度,新型RNN路線已成為這一方向的絕對主流,其他路線逐漸式微。

量子位智庫還對近年主流的非Transformer架構行業熱度進行了盤點,幫助讀者判斷各個非Transformer的工業和學術潛力。

具體的非Transformer架構突圍情況點擊文末的報告鏈接獲取閱讀。

另外,量子位智庫還從與多位行業一線專家的交流調研中提煉出了大模型架構創新的核心Insight。

對于近年來架構創新涌現,行業內有兩種主流看法,一種認為這是力大飛磚、捅天花板派和壓縮智能密度、追求智能普惠派的路線之爭。

另一種看法是,這是技術迭代螺旋演進的正常周期,這一周期在歷史上已多次重復上演。

而我們目前或許正處在下一個Transformer誕生、新技術突破出現的前夜。

目前行業內的共識是,下一代主流架構要想替代Transformer需要實現三個參數規模Scaling突破的驚險跳躍——10B、20B和100B。

目前,絕大多數的架構創新改進仍然停留在10B階段。

而我們的終極問題是,下一個Transformer將從何處誕生,誰將為我們帶來The Next Big Thing?

為回答這一問題,我們對近年來在架構創新方面活躍的組織機構和專家學者進行了一次Mapping。

試圖在新突破的前夜,提前捕捉到在“架構拐點”臨界線上閃爍的創新火光。

完整報告和詳細內容,請在下方鏈接獲取。

報告下載鏈接:

https://jkhbjkhb.feishu.cn/wiki/W5D7wuDcbiPXDLkaRLQcAJpOn8f

- AI Coding玩家圖譜:誰在押注,誰在突圍?| 量子位智庫報告2025-09-01

- 一份報告看盡2025上半年AI核心趨勢,應用、模型、技術、行業全覆蓋| 量子位智庫2025-08-11

- AI重塑游戲未來:79%開發者擁抱,8大環節迎革新|AI+游戲產業變革研究報告發布2025-07-15

- 大模型落地與前沿趨勢研究報告 | 量子位智庫2025-06-19