草圖人像變3D模特,360° 無(wú)死角還原姿勢(shì),一張就行,多“草”都可|SIGGRAPH 2022

可親自上手試驗(yàn)一把

豐色 發(fā)自 凹非寺

量子位 | 公眾號(hào) QbitAI

一張隨便勾畫(huà)的草圖,居然也可以分分鐘自動(dòng)變成逼真的3D模型?!

360° 無(wú)死角不說(shuō),轉(zhuǎn)換期間真的不需要任何其它角度姿勢(shì)的輸入。

這就是獲得了SIGGRAPH 2022榮譽(yù)獎(jiǎng)的一個(gè)最新3D姿態(tài)估計(jì)模型:

Sketch2Pose。

除了草圖,像這樣的小猴子,四肢嚴(yán)重不按比例生長(zhǎng),Sketch2Pose也可以辦到:

這是如何做到的?

只要4步,草圖人變3D人

將草圖上的人物/形象變成3D模型,此前的研究中都還未專門涉及。

該任務(wù)最大的挑戰(zhàn)就是比例失真問(wèn)題,因?yàn)楫?huà)上的東西可能頭大身子小、胳膊長(zhǎng)腿短……

為此,Sketch2Pose通過(guò)對(duì)三個(gè)關(guān)鍵元素進(jìn)行預(yù)測(cè)來(lái)消除繪制姿勢(shì)時(shí)的可能出現(xiàn)的“歧義”。

這三個(gè)元素分別是:

2D骨骼切線(2D bone tangents)自接觸區(qū)域(self-contacts)骨骼縮短比例(bone foreshortening)其中,2D骨骼切線(下圖藍(lán)色部分)是預(yù)測(cè)3D骨骼方向最有力的指標(biāo)(關(guān)節(jié)位置不行)。

自接觸區(qū)域(如下圖綠色部分,手接觸腰的位置)對(duì)于理解3D姿勢(shì)至關(guān)重要,也是消除未知身體部位歧義的線索。

骨骼縮短轉(zhuǎn)換系統(tǒng)則利用統(tǒng)計(jì)分析來(lái)糾正原圖中的比例問(wèn)題。

根據(jù)這三者預(yù)測(cè),再使用最先進(jìn)的優(yōu)化框架(optimization framework),并用專門設(shè)計(jì)的一種新的損失(loss)來(lái)平衡姿勢(shì)自然度,以及與輸入草圖的相似性,AI就能最終推斷出符合畫(huà)者意向的3D姿勢(shì)。

具體步驟如下:

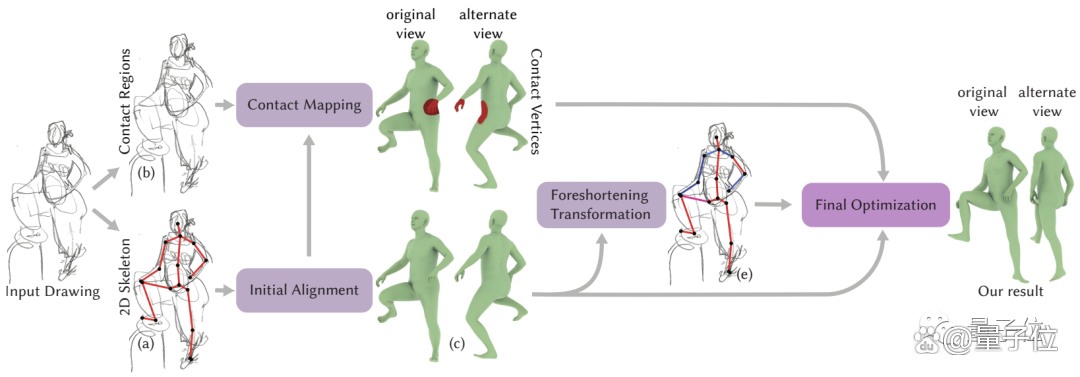

輸入一張草圖,首先預(yù)測(cè)出2D關(guān)節(jié)位置或骨架,用于3D人體模型的粗略對(duì)齊。

然后預(yù)測(cè)屏幕空間(screen-space)接觸區(qū)域,將其映射到粗略對(duì)齊的3D模型上,得到一組接觸頂點(diǎn)(紅色部分)。

接著,利用縮短轉(zhuǎn)換階段描述的草圖人物比例問(wèn)題,進(jìn)行修補(bǔ)。

最后,在優(yōu)化框架中利用2D骨架的骨骼切線、粗略對(duì)齊的3D姿勢(shì)以及比例修補(bǔ),產(chǎn)生最終結(jié)果。

有遮擋缺失也OK

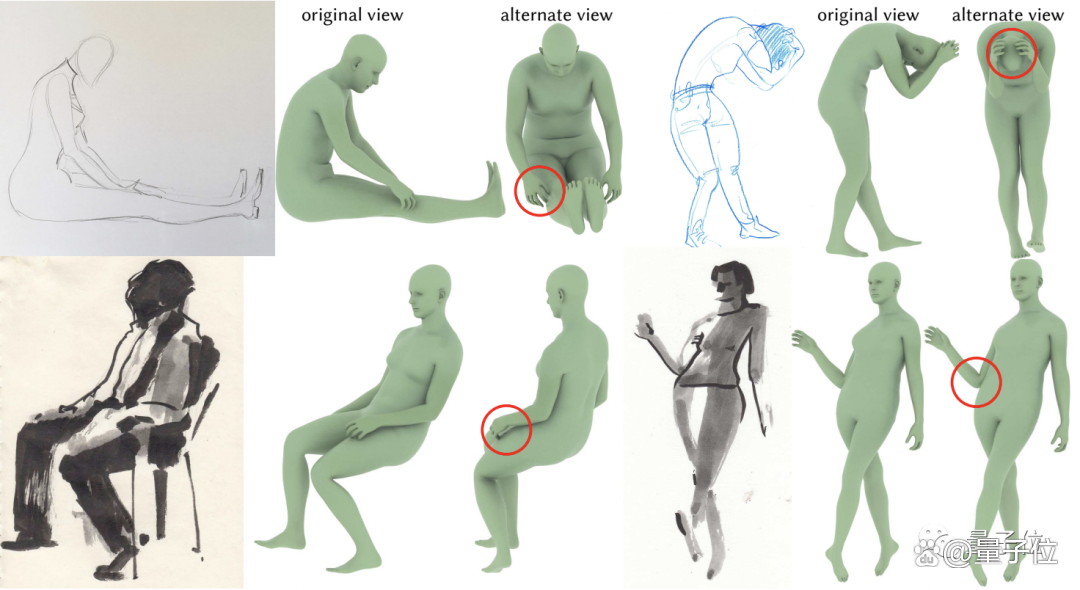

最終的Sketch2Pose可以支持多種草圖風(fēng)格的轉(zhuǎn)換,比如下圖中的簡(jiǎn)筆畫(huà)或者水墨畫(huà),像下下圖最后一張那樣簡(jiǎn)略的也可以。

同時(shí),對(duì)缺失、遮擋部位也能穩(wěn)健處理。

比如上圖第一行中的人手(不過(guò)我們發(fā)現(xiàn)左邊的似乎推測(cè)有錯(cuò),手應(yīng)該是放在兩腿之間;右邊的抱頭基本沒(méi)啥問(wèn)題,但手掌應(yīng)該向后彎曲)。

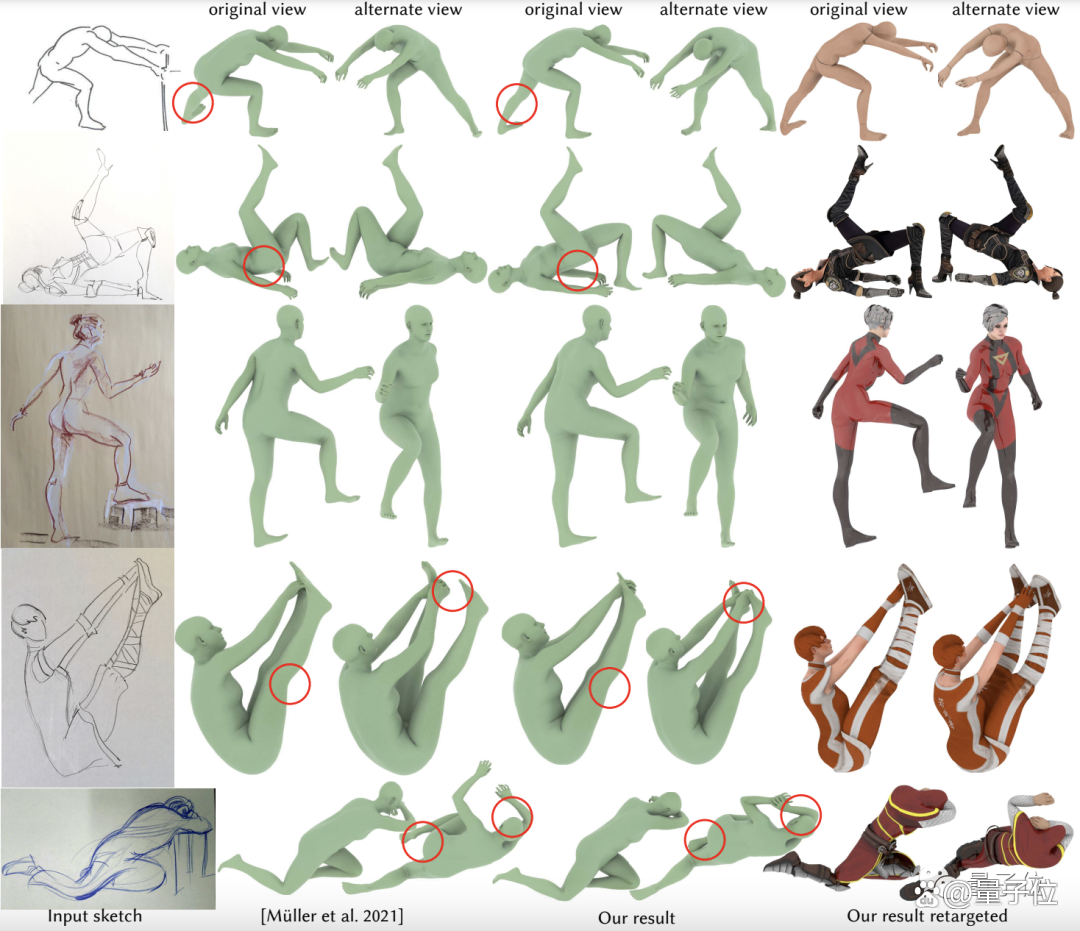

再將Sketch2Pose和SOTA方法進(jìn)行比較,結(jié)果還是令人非常滿意的。

可以看到,Sketch2Pose(第三列)對(duì)姿勢(shì)還原的更到位,缺失部分的預(yù)測(cè)也更符合人體構(gòu)造。

而開(kāi)頭那只小猴子,Müller et al. 2021等方法的轉(zhuǎn)換效果就是下面這樣:

對(duì)于猴子“扭曲”的下肢部分,這些方法都出現(xiàn)了理解偏差——Sketch2Pose完勝。

作者介紹

Sketch2Pose一共有兩位作者,都來(lái)自加拿大蒙特利爾大學(xué)。

一作名叫Kirill Brodt (Кирилл Бродт),出生于1991年,本碩畢業(yè)于新西伯利亞州立大學(xué)(數(shù)學(xué)學(xué)位),后在Yandex數(shù)據(jù)分析和計(jì)算機(jī)科學(xué)中心學(xué)院學(xué)習(xí)機(jī)器學(xué)習(xí),現(xiàn)為蒙特利爾大學(xué)的一位博士生。

他的主要研究方向?yàn)楦輬D有關(guān)的計(jì)算機(jī)視覺(jué)轉(zhuǎn)換。

另一位作者名叫Mikhail Bessmeltsev,是一作的導(dǎo)師,蒙特利爾大學(xué)計(jì)算機(jī)科學(xué)與運(yùn)籌學(xué)系的助理教授。

感興趣的同學(xué)可以戳論文原文,或者去Huggingface上試試效果。

論文原文:

https://dl.acm.org/doi/10.1145/3528223.3530106

項(xiàng)目主頁(yè):

https://www-labs.iro.umontreal.ca/~bmpix/sketch2pose/

Huggingface demo:

https://huggingface.co/spaces/SIGGRAPH2022/sketch2pose

Github代碼:

https://github.com/kbrodt/sketch2pose

- 北大開(kāi)源最強(qiáng)aiXcoder-7B代碼大模型!聚焦真實(shí)開(kāi)發(fā)場(chǎng)景,專為企業(yè)私有部署設(shè)計(jì)2024-04-09

- 剛剛,圖靈獎(jiǎng)揭曉!史上首位數(shù)學(xué)和計(jì)算機(jī)最高獎(jiǎng)“雙料王”出現(xiàn)了2024-04-10

- 8.3K Stars!《多模態(tài)大語(yǔ)言模型綜述》重大升級(jí)2024-04-10

- 谷歌最強(qiáng)大模型免費(fèi)開(kāi)放了!長(zhǎng)音頻理解功能獨(dú)一份,100萬(wàn)上下文敞開(kāi)用2024-04-10